Gli Xeon basati sul design “Cascade Lake”, chiamati ufficialmente Xeon Scalable di seconda generazione, arrivano in un momento critico per Intel. I nuovi processori promettono più core e prestazioni con prezzi simili ai modelli precedenti.

Gli Xeon di Intel sono a bordo all’incirca del 96% dei server mondiali. La prima generazione di CPU EPYC di AMD ha tuttavia iniziato a sottrarre quote di mercato. Le grandi aziende tendono ad aspettare che le architetture diventino mature prima di adottarle, e questo è il motivo per cui gli EPYC di seconda generazione “Rome” rappresentano un vero pericolo per il dominio di Intel.

Le nuove CPU AMD useranno il processo produttivo a 7 nanometri che è più denso dei 14 nanometri di Intel, offrendo al contempo una migliore efficienza energetica. Questo processo produttivo più avanzato garantirà fino a 64 core e 128 thread in un singolo package, battendo la migliore soluzione di Intel.

Le CPU Rome di AMD arriveranno più avanti nel corso dell’anno, lasciando Intel con un grande gap da colmare prima dell’arrivo dei processori Cooper Lake a 14 nanometri e poi dei ripetutamente rimandati Xeon Ice Lake a 10 nanometri nel 2020.

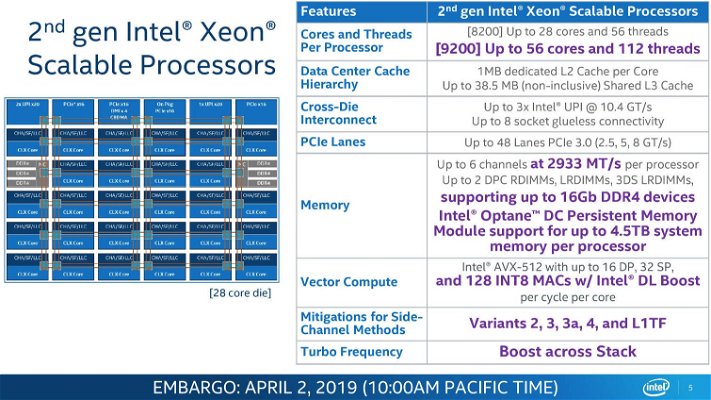

In preparazione degli EPYC Rome con 64 core / 128 thread, Intel ha introdotto la serie Xeon Platinum 9000, con un massimo di 56 core, 112 thread e 12 canali di memoria in un singolo package che dissipa fino a 400W. Questi nuovi colossi, che sono essenzialmente due CPU Skylake-SP in un singolo socket, arrivano solo all’interno dei server OEM, non sono disponibili al dettaglio.

Malgrado l’impressionante arsenale di chip Cascade Lake introdotti, questo lancio è maggiormente riconoscibile come un altro passo evolutivo in avanti per le ambizioni di Intel di diventare un’azienda in grado di fornire una piattaforma anziché un semplice venditore di chip per datacenter. L’aggiunta delle DIMM Optane DC Persistent Memory apre nuove strade a Intel nel mercato delle memorie. Inoltre l’azienda si sta espandendo in business complementari con nuovi SSD, sia nelle versioni NAND e Optane, insieme alle soluzioni di rete 100G Columbiaville.

L’obiettivo ambizioso di diventare un provider di soluzioni complete è comunque legato alla capacità di fornire processori concorrenziali. Diamo perciò uno sguardo agli ultimi Xeon giunti nel nostro laboratorio.

Intel Cascade Lake Xeon Platinum 8280, Platinum 8268 e Gold 6230

Gli Xeon Cascade Lake adottano la stessa microarchitettura Skylake-SP dei loro predecessori, il che significa che non vedrete miglioramenti prestazionali attribuibili a cambiamenti del design sottostante. Intel offre comunque dei miglioramenti per attrarre nuovi clienti, come il supporto a una DRAM più veloce, il supporto fino a 4,5 TB di DIMM Optane DC Persistent Memory sui modelli Platinum e Gold, una capacità di memoria massima più alta, più cache L3 su molti modelli di fascia media, il processo produttivo 14nm++ che Intel dice migliora le frequenze e i consumi e il supporto a nuove istruzioni dedicati ai carichi di lavoro legati all’intelligenza artificiale.

Intel usa anche la stessa configurazione dei die (XCC, HCC, LCC) con l’interconnessione mesh per i modelli mainstream Platinum, Gold, Bronze e Silver. Di conseguenza il numero dei core raggiunge un massimo di 28, rimanendo dietro alla gamma EPYC di prima generazione (Naples) con un massimo di 32 core e 64 thread.

Un messaggio fondamentale che vuole veicolare Intel è che avete più prestazioni per lo stesso prezzo rispetto al passato. Possiamo vedere che l’azienda lo fa offrendo 200 MHz di frequenza base / Turbo Boost lungo l’intera gamma rispetto ai modelli Skylake-SP, insieme al passaggio a sei canali di memoria DDR4-2933 (invece di DDR4-2666). La capacità di memoria è stata portata a un massimo di 1 TB per chip, con i modelli più costosi che supportano 2 TB o 4,5 TB. È degno di nota però che i modelli base con supporto di 1 TB per socket inseguano comunque gli EPYC, che arrivano a 2 TB.

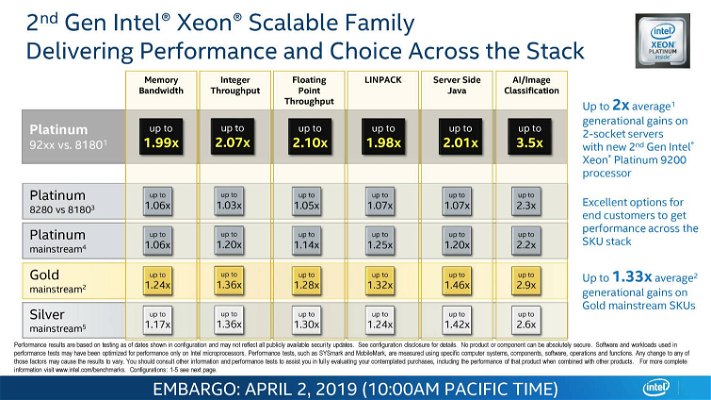

In generale Intel afferma che i nuovi chip offrono un aumento prestazionale da una generazione all’altra del 30%. Il Gold 6230 è rappresentativo di molti dei miglioramenti dell’azienda. Ha frequenze di Turbo Boost più alte, quattro core con Hyper-Threading in più e un maggior quantitativo di cache L3, il tutto allo stesso prezzo di 1894 dollari del suo predecessore.

| Cascade Lake Platinum 8280 | Skylake-SP Platinum 8180 | AMD EPYC 7601 | Cascade Lake Platinum 8268 | Skylake-SP Platinum 8168 | Cascade Lake Gold 6230 | Skylake-SP Gold 6130 | |

| Prezzo (RCP) | $10,009 | $10,009 | $4,500 | $6,302 | $5,890 | $1,894 | $1,894 |

| Socket | LGA 3647 | LGA 3647 | SP4 | LGA 3647 | LGA 3647 | LGA 3647 | LGA 3647 |

| Core/Thread | 28 / 56 | 28 / 56 | 32 / 64 | 24 / 48 | 24 / 48 | 20 / 40 | 16 / 32 |

| TDP | 205W | 205W | 180W | 205W | 205W | 125W | 125W |

| Freq. Base | 2.7 GHz | 2.5 GHz | 2.2 GHz | 2.9 GHz | 2.7 GHz | 2.1 GHz | 2.1 GHz |

| Freq. Turbo | 4 GHz | 3.8 GHz | 3.2 GHz | 3.9 GHz | 3.7 GHz | 3.9 GHz | 3.7 GHz |

| Cache L3 | 38.5MB | 38.5MB | 64MB | 35.75MB | 33MB | 28MB | 22MB |

| SupportoMemoria | 6 canali DDR4-2933 | 6 canali DDR4-2666 | 8 canali DDR4-2666 | 6 canali DDR4-2933 | 6 canali DDR4-2666 | 6 canali DDR4-2933 | 6 canali DDR4-2666 |

| Linee PCIe | 48 | 48 | 128 | 48 | 48 | 48 | 48 |

| Scalabilità (fino a) | 8-Socket | 8-Socket | 2-Socket | 8-Socket | 8-Socket | 4-Socket | 4-Socket |

| Capacità memoria | 1TB | 768GB | 2TB | 1TB | 768GB | 1TB | 768GB |

Come gli Xeon Scalable di precedente generazione, i modelli Cascade Lake sono compatibili con l’interfaccia LGA 3647 (Socket P) su piattaforme con PCH C610 (Lewisburg), e si possono installare sulle schede madre server esistenti. I partner OEM di Intel hanno anche rilasciato una nuova ondata di piattaforme che supportano le nuove tecnologie, incluse le DIMM Optane DC Persistent Memory.

In virtù della stessa microarchitettura, i processori Cascade Lake offrono ancora 48 linee PCI Express 3.0. I processori EPYC di AMD ne hanno 128, il che si traduce in un grande vantaggio per i server con molti dispositivi di archiviazione NVMe e configurazioni multi-GPU usate per il deep learning. Intel sta lavorando per sopperire a questa debolezza. Un nuova suite chiamata DL Boost aggiunge il supporto a diverse funzionalità che secondo l’azienda garantiscono un miglioramento prestazionale di 14 volte nei carichi di inferenza IA.

Intel ha anche aggiunto il supporto per VNNI (Vector Neural Network Instructions), che sono istruzioni ottimizzati per piccoli tipi di dati usati comunemente nelle operazioni di machine learning. VNNI fonde tre istruzioni insieme per aumentare le prestazioni int8 (VPDPBUSD) o un paio di istruazioni per aumentare il throughput int16 (VPDPWSSD). Queste operazioni sono comunque conformi alla curva di tensione / frequenza delle istruzioni AVX-512.

Con la piattaforma Cascade Lake la casa di Santa Clara introduce Intel Optane DC Persistent Memory. Queste nuove DIMM s’inseriscono nell’interfaccia DRAM, come un normale modulo di memoria. Sono disponibili in capacità di 128, 256 e 512 GB e possono essere usate sia come memoria che come archiviazione. A differenza della DRAM, 3D XPoint mantiene i dati dopo lo spegnimento del sistema, permettendo così nuovi casi d’uso. L’obiettivo è di colmare il gap tra storage e memoria, potenzialmente aumentando la capacità fino a 6,5 TB in un server dual-socket a un prezzo molto più amichevole.

Le DIMM sono indirizzabili in due modalità, App Direct o Memory Mode. La prima espone le DIMM come un dispositivo di archiviazione e l’ultima permette alle applicazioni di usare le DIMM Optane come un livello di memoria più lento. In tale modalità, Optane Memory può salvare i “dati freddi” che solitamente sono archiviati nella memoria principale, mentre i dati ad accesso frequente sono salvati nella memoria di sistema, il che essenzialmente serve come una cache per le DIMM Optane. Le applicazioni possono inoltre controllare direttamente il posizionamento dei dati nella DRAM e Optane Memory, anche se il tutto deve essere ottimizzato per il massimo beneficio.

Intel ha anche progettato un nuovo controller di memoria per supportare le DIMM e assistere nell’identificare i dati per il caching. Tuttavia, non condivide i dettagli architettonici più fini. Sappiamo che le DIMM sono fisicamente ed elettronicamente compatibili con lo slot DIMM standard JEDEC, ma usa il protocollo DDR-T proprietario di Intel per gestire la latenza irregolare che deriva dalla scrittura di dati nella memoria persistente. Le DIMM Optane condividono un canale di memoria con gli slot DIMM normali, e sono compatibili solo con gli Xeon Cascade Lake (e successivi). Di questi punti da conoscere, il più importante è che le DIMM Optane funzionano solo a DDR4-2666, cosa che limita tutta la memoria nel sistema alla stessa velocità.