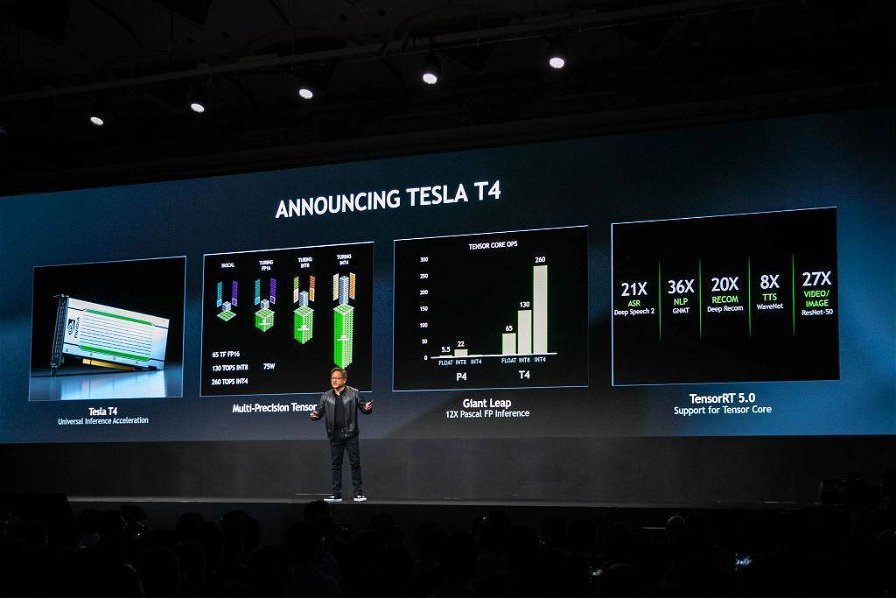

Grande successo per la Tesla T4, la soluzione di Nvidia basata su architettura Turing pensata per il mondo del deep learning. L'azienda ha annunciato nel corso del Supercomputing 2018 che la scheda acceleratrice ha ricevuto "la più rapida adozione di qualsiasi GPU server". A due mesi dal debutto la T4 è a bordo di 57 progetti di server differenti dei principali produttori (Dell EMC, Hewlett Packard Enterprise, IBM, Lenovo e Supermicro) e ora è disponibile anche via cloud, grazie a Google Cloud Platform.

"Non abbiamo mai visto un'adozione così rapida di un processore per datacenter", ha dichiarato Ian Buck, vicepresidente e direttore generale per l'Accelerated Computing di Nvidia. "A soli 60 giorni dal lancio, la T4 è disponibile nel cloud ed è supportata da una rete mondiale di produttori di server. T4 offre ai cloud pubblici e privati le prestazioni e l'efficienza necessarie per carichi di elaborazione intensivi su vasta scala".

La T4 può accelerare diversi carichi cloud, tra cui high performance computing, allenamento e inferenza nell'ambito del deep learning, machine learning, data analytics e grafica. Specifiche alla mano, la Tesla T4 è dotata di una GPU con 2560 CUDA core e 320 Tensor core. Nel die sono presenti anche diverse unità RT core.

"La visualizzazione in tempo reale e l'inferenza online richiedono una bassa latenza. Siamo lieti di collaborare con Nvidia per offrire il supporto alla GPU T4 ai clienti di Google Cloud", ha affermato Damion Heredia, senior director of Product Management di Google Cloud. "Le GPU Nvidia T4 per Google Cloud offrono una piattaforma altamente scalabile, conveniente e a bassa latenza per i nostri clienti. Le funzionalità di rete di Google Cloud insieme alla Tesla T4 consentono ai clienti di innovare in nuovi modi, velocizzando le applicazioni e riducendo i costi". I clienti interessati possono sottoscrivere il programma ad accesso anticipato di Google Cloud.

La T4 si presenta in un design a basso profilo, con un TDP all'incirca di 70/75 watt e può essere inserita in qualsiasi server standard o design hyperscale che segue i dettami dell'Open Compute Project. I server possono spaziare da una singola GPU T4 fino 20 GPU in singolo nodo. Per quanto concerne le prestazioni, la scheda raggiunge 8,1 TFLOPs con calcoli FP32 (la precedente P4 raggiunge 5,5 TFLOPs), 65 TFLOPs in FP16, 130 TOPs con calcoli INT8 (22 TOPS per la Tesla P4) e 260 TOPs con quelli INT4.

Secondo Nvidia, per i carichi di inferenza legati alle AI "un server con due GPU T4 può rimpiazzare i server formati da 54 CPU. Per l'allenamento delle AI, un server con due GPU T4 può sostituire nove server dual-socket composti da sole CPU".

Parallelamente a questo annuncio, Nvidia ha sottolineato la sua presenza nella classifica TOP500 dei supercomputer, di cui vi abbiamo parlato ieri. In un anno il numero di sistemi con acceleratori Nvidia è cresciuto del 48%, salendo da 86 a 127 unità, tre volte in più rispetto a cinque anni fa. L'azienda ha rimarcato la presenza all'interno di Summit e Sierra, i due supercomputer più veloci al mondo, ma anche la presenza in 22 dei 25 sistemi più efficienti al mondo.