Ci sono molti incontri in cui si parla di AI, ma quello organizzato recentemente da Bloomberg ha raccolto alcune tra le persone più influenti ed esperte del settore. Tra i partecipanti c’erano anche Meredith Whittaker (Signal), Navrina Singh (Credo AI) e Alex Hanna (Distributed AI Research Institute).

I tre hanno partecipato a una tavola rotonda che li ha visti concordi su almeno un punto: non lasciatevi distrarre dalle promesse e dalle minacce associate al futuro dell'AI. Non è magica, non è completamente automatizzata e, come ha detto Whittaker, è già invasiva al di là di quanto la maggior parte degli americani possa apparentemente comprendere.

E, aggiungo io, probabilmente vale lo stesso anche per i cittadini di altre nazioni. In qualche modo, pare che le persone che controllano gli algoritmi stiano già plasmando un mondo distopico, qualcosa che potrebbe somigliare Il Mondo Nuovo di Huxley più che a 1984 di Orwell - ma nel dubbio consiglio la lettura di entrambi i testi, che male non fa

Tanto per cominciare, dovremmo tenere più in considerazione il fatto che c’è un esercito di persone che sta addestrando gli algoritmi (ma anche loro hanno cominciato a usare strumenti IA per facilitarsi il lavoro).

Uno dei problemi è che non si parla abbastanza di queste persone; un po’ perché sull’IA si è costruita una narrativa fatta di “magia” che sarebbe rovinata se si sapesse che dietro ci sono persone che lavorano. E un po’ perché spesso si tratta di lavoro invisibile e sottopagato e, come nel caso dell’abbigliamento, per chi fa il prodotto è meglio che non si sappia troppo in giro da dove viene.

Il tema è stato introdotto da Hanna, a cui ha fatto eco Whittaker, che vanta una lunga esperienza in ambito AI: ha sottolineato che il pericolo più immediato, quando si parla di AI, è ce sta concentrando molto potere nelle mani di quei pochi che si trovano in cima alla piramide dell'intelligenza artificiale avanzata.

Tutti gli altri, per la maggior parte, sono soggetti all’IA, non utenti dell’IA. Una frase che potrebbe non essere facile da capire, ma se parlate con un servizio clienti, chiedete un finanziamento, stipulate un’assicurazione o comprate un biglietto aereo, spesso e volentieri il vostro successo dipenderà da un algoritmo. Le informazioni che le IA hanno su di noi vengono usate per prendere decisioni che influenzano direttamente le nostre vite; su questo punto mi permetterò di citare Bohr per dire che se la teoria del dominio delle IA non vi sconvolge, è perché non l'avete capita.

Insomma, chi controlla gli algoritmi controlla le nostre vite, e al limite si può discutere di fino a che punto sono arrivati e fino a che punto potrebbero arrivare. C’è un film italiano che ha affrontato l’argomento; non è un capolavoro ma mi sento di consigliarlo, per il taglio diverso ma efficace rispetto ad altre opere più famose: se potete, date un’occhiata a E noi come stronzi rimanemmo a guardare (disponibile su Sky e SkyNow).

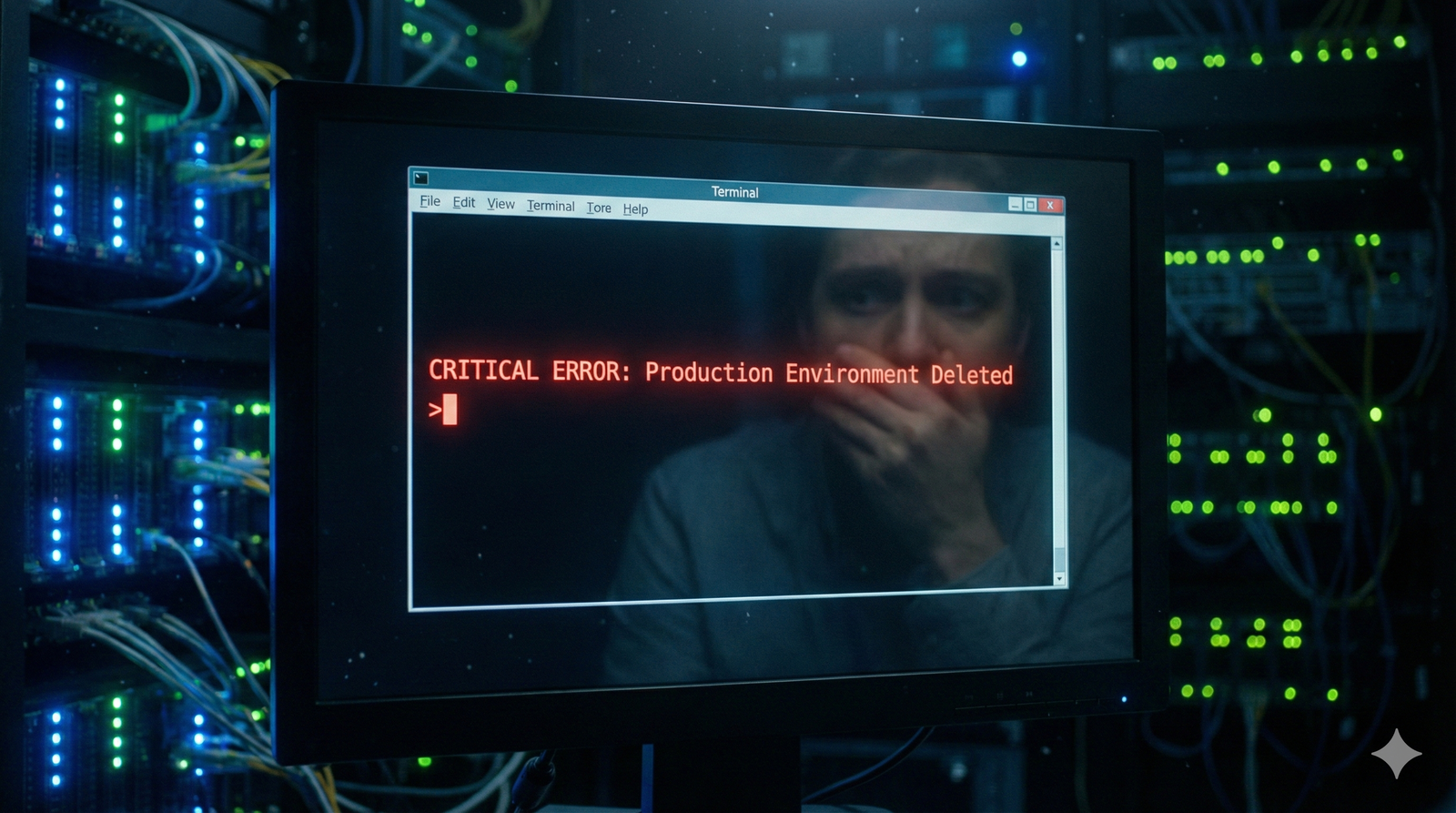

In tutto questo, i capi delle società IA del mondo non sembrano molto inclini ad affrontare questi temi: ormai non si contano i dipendenti che sono stati allontanati o si sono dimessi perché volevano trattare questioni etiche.

Tra le molte possibili questioni, per capire che cosa sia l’IA veramente, Whittaker suggerisce di considerare una realtà concreta: oggi i potenti algoritmi esistenti sono tecnologie di sorveglianza.

La Whittaker ha precisato che l'IA "richiede una sorveglianza sotto forma di questi enormi set di dati che rafforzano ed espandono la necessità di un numero sempre maggiore di dati e di una raccolta sempre più intima. La soluzione a tutto è rappresentata da più dati, più conoscenze messe in comune nelle mani di queste aziende. Ma questi sistemi sono anche utilizzati come dispositivi di sorveglianza. E credo che sia davvero importante riconoscere che non importa se l'output di un sistema di intelligenza artificiale è prodotto attraverso una stima statistica probabilistica, o se si tratta di dati provenienti da un ripetitore che triangola la mia posizione. Quei dati diventano dati su di me. Non è necessario che siano corretti. Non è necessario che riflettano chi sono o dove sono. Ma hanno un potere significativo sulla mia vita, che viene messo nelle mani di queste aziende".

In effetti, ha aggiunto, "il diagramma di Venn delle preoccupazioni relative all'IA e alla privacy è un cerchio".

Forse lo scenario che ne emerge è eccessivo, poco veritiero, magari un po’ allarmistico. Ma almeno in parte è realistico: l’IA sta cambiando gli equilibri di potere, e sta rendendo noi cittadini del “primo mondo” più deboli ed esposti ai capricci di pochissimi individui.

Rischiamo di alzarci una mattina e scoprire che certe paure alla fine sì che erano fondate, ma in quel momento sarà già troppo tardi per fare qualcosa. E allora, forse, è il caso di preoccuparsi prima.

Certo, a nessuno piace pensare a un pericolo che potrebbe essere; meglio vivere più o meno tranquilli, e se possibile trasformare tutto in spettacolo e intrattenimento. Succede con la crisi climatica e con le IA, che sono le due più grandi questioni che dobbiamo affrontare. La vera magia è che una potrebbe servirci per risolvere l’altra.

Ma intanto, a proposito di “preferisco non pensarci”, c’è un altro film da vedere stasera. Si chiama Don’t look up e lo trovate su Netflix.