Samsung Electronics riconquista la leadership nel mercato globale delle memorie DRAM nel terzo trimestre del 2025 dopo averla momentaneamente ceduta alla connazionale SK Hynix.

Il ritorno al vertice del colosso sudcoreano segna un punto di svolta in un settore che sta vivendo un vero e proprio super-ciclo trainato dall'esplosione della domanda di componenti per l'intelligenza artificiale. Con ricavi che sfiorano i 14 miliardi di dollari e una crescita trimestrale del 30%, Samsung dimostra di aver superato i problemi che ne avevano frenato la corsa nei mesi precedenti.

I dati del terzo trimestre 2025 parlano chiaro: Samsung ha registrato ricavi per 13,942 miliardi di dollari nel segmento DRAM, consolidando una quota di mercato del 34,8%. Si tratta di un balzo impressionante rispetto al trimestre precedente, che riflette non solo la crescita organica del mercato ma soprattutto la capacità dell'azienda di risolvere i colli di bottiglia che ne avevano minato la competitività. La distanza con SK Hynix, ferma a 13,79 miliardi di dollari e al 34,4% di quota, è minima ma sufficiente a ridisegnare gli equilibri del settore.

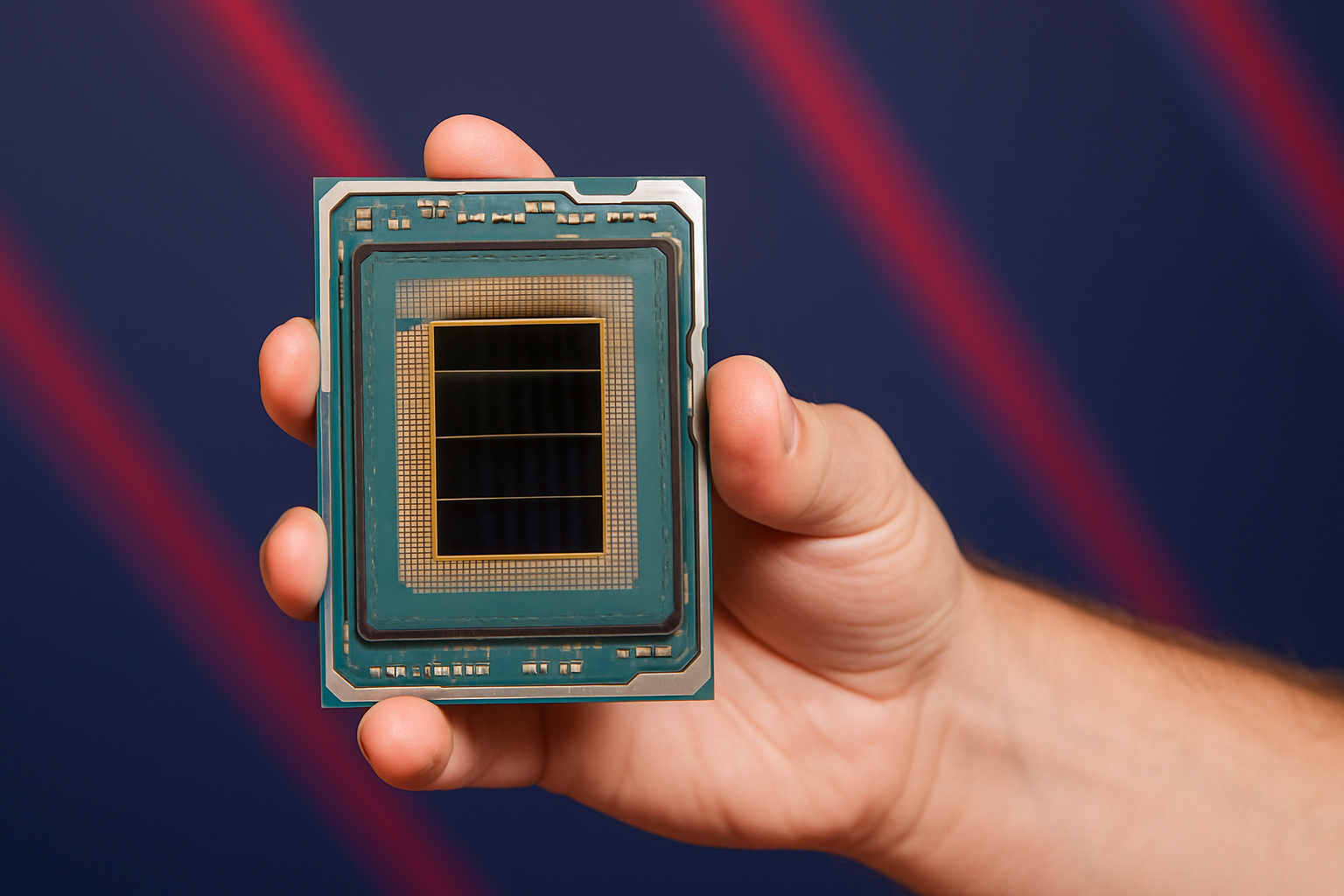

Il sorpasso subito da SK Hynix nei primi mesi dell'anno era stato determinato principalmente dalle difficoltà di Samsung nel segmento delle memorie ad alta larghezza di banda (HBM). Le memorie HBM3e, cruciali per le GPU utilizzate nei data center dedicati all'addestramento di modelli di intelligenza artificiale, avevano incontrato ostacoli nel processo di qualificazione presso i clienti chiave. NVIDIA, leader indiscusso nel mercato delle GPU per AI, aveva ritardato le approvazioni dei prodotti Samsung, permettendo a SK Hynix di accaparrarsi contratti miliardari e consolidare la propria posizione.

La ripresa di Samsung sembra ora consolidata, con la società che ha evidentemente risolto i problemi tecnici o di processo che avevano rallentato la validazione delle sue memorie HBM di ultima generazione. L'approvazione da parte dei grandi clienti ha sbloccato volumi di vendita significativi, permettendo al gigante coreano di recuperare terreno in un segmento che rappresenta una delle aree più redditizie del mercato DRAM. Le memorie HBM3e offrono larghezze di banda superiori ai 1 TB/s e sono fondamentali per alimentare le GPU H100 e H200 di NVIDIA, oltre alle soluzioni concorrenti di AMD.

Il contesto di mercato favorisce entrambi i contendenti: l'intelligenza artificiale sta spingendo la domanda di memorie DRAM in territorio di super-ciclo, una fase caratterizzata da crescita sostenuta, margini elevati e prezzi in ascesa. Samsung ha già implementato aumenti di prezzo fino al 60% su alcune linee di prodotto, segnale della forza contrattuale che i produttori di memorie hanno recuperato dopo anni difficili. Questa dinamica ribalta completamente il periodo di sovracapacità e prezzi depressi che aveva caratterizzato il mercato tra il 2022 e il 2023.

La battaglia tra Samsung e SK Hynix non è destinata a placarsi nei prossimi trimestri. Con margini così risicati nella quota di mercato, basterà un singolo contratto importante o un ritardo nelle forniture per ribaltare nuovamente le posizioni. Entrambe le aziende stanno investendo miliardi in nuovi impianti di produzione e nello sviluppo delle memorie HBM4, previste per il 2026, che promettono larghezze di banda ancora superiori per alimentare la prossima generazione di acceleratori AI. Micron Technology, terzo produttore globale, osserva dalla distanza ma sta progressivamente colmando il gap tecnologico nel segmento HBM.

Per i consumatori e le aziende, questa competizione serrata ha implicazioni contrastanti. Da un lato, l'innovazione tecnologica procede a ritmo sostenuto, con memorie sempre più veloci e capienti che abilitano capacità computazionali senza precedenti. Dall'altro, la concentrazione del mercato in poche mani e la domanda eccezionale stanno sostenendo prezzi elevati, con impatti sui costi dei server per data center e, indirettamente, sui servizi cloud utilizzati da milioni di utenti. La sfida per i prossimi anni sarà bilanciare l'espansione della capacità produttiva con una domanda che mostra pochi segni di rallentamento, specialmente nel segmento enterprise legato all'AI generativa e al machine learning su larga scala.