OpenAI ha annunciato che ChatGPT non è più soltanto un chatbot conversazionale, ma si è trasformato in un vero e proprio assistente digitale in grado di operare autonomamente sul web e sui dispositivi locali. Sarà quindi possibile utilizzarlo per automatizzare interazioni con strumenti e siti web di ogni genere. Allo stesso tempo, può vedere e sfruttare i dati sul computer.

Dalla conversazione all'azione: la nuova frontiera dell'AI

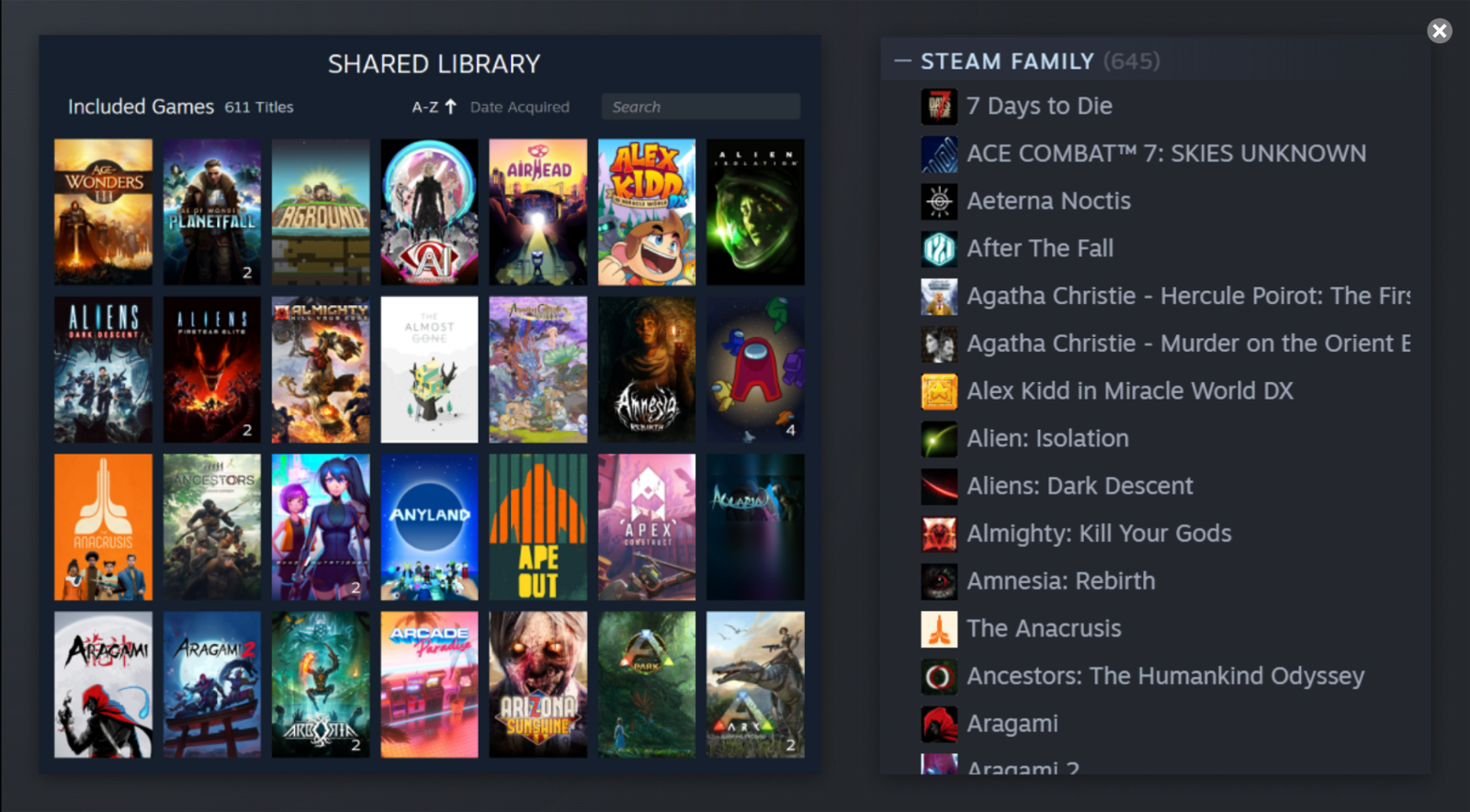

Il nuovo sistema permette agli utenti di impartire comandi complessi come "Costruisci un modello di burn rate per la mia startup di intelligenza artificiale" e aspettarsi che l'agente acceda autonomamente ai file locali, agli strumenti di calcolo e alle risorse online necessarie per completare il compito. L'agente ChatGPT incorpora le capacità di Operator di OpenAI, il che significa che può interagire direttamente con gli elementi delle pagine web, oltre a utilizzare strumenti di ricerca avanzati.

La piattaforma dispone di accesso sia a un browser visuale che testuale, un terminale, le API di OpenAI e connettori per servizi come Gmail e GitHub. Secondo l'azienda, l'agente opera in una macchina virtuale dedicata che preserva il contesto delle interazioni, mantenendo la memoria delle richieste, risposte e dati elaborati.

Disponibilità e accesso alle nuove funzionalità

Le nuove capacità sono disponibili come opzione dal menu Strumenti di ChatGPT per gli abbonati Pro, Plus e Team, mentre gli utenti Education e Enterprise potranno accedervi nelle prossime settimane. Questa release segna la prima volta che gli utenti possono chiedere a ChatGPT di intraprendere azioni sul web, come sottolinea l'azienda di Sam Altman nel suo annuncio.

I rischi nascosti dell'automazione intelligente

Tuttavia, concedere ai modelli linguistici la capacità di eseguire azioni sui siti web e persino effettuare acquisti comporta rischi significativamente maggiori rispetto alla semplice conversazione con un chatbot. OpenAI ha implementato controlli di sicurezza potenziati, prestando particolare attenzione alla protezione contro l'iniezione di prompt malevoli (prompt injection), una minaccia particolarmente insidiosa per i sistemi agentici che processano grandi quantità di dati e dispongono di ampie autorizzazioni di accesso.

Un esempio concreto di questa vulnerabilità potrebbe essere un prompt malevolo nascosto in una pagina web, magari in elementi invisibili o nei metadati, che potrebbe indurre l'agente a compiere azioni non volute come condividere dati privati con un attaccante o eseguire operazioni dannose su siti in cui l'utente ha effettuato l'accesso.

Contromisure e percentuali di successo nella difesa

Per contrastare questi scenari, OpenAI ha implementato diverse difese: l'agente richiede permesso prima di intraprendere azioni che influiscono sul mondo reale, richiede supervisione per compiti come l'invio di email e rifiuta di eseguire attività ad alto rischio come trasferimenti di denaro da conti bancari. La scheda tecnica del modello indica che l'AI bot è molto resistente all'iniezione di prompt, ignorando il 99,5% delle istruzioni sintetiche irrilevanti o dei tentativi di esfiltrazione dati su pagine web.

Quando gli attacchi coinvolgono scenari identificati dai ricercatori del red team, il tasso di resistenza scende al 95%. La questione della biosicurezza rimane sotto osservazione: pur non avendo prove che i novizi possano utilizzare l'agente ChatGPT per creare armi biologiche, l'azienda sta comunque "esercitando cautela e implementando le necessarie misure di sicurezza".