L'efficacia e la raffinatezza degli attuali modelli di Intelligenza Artificiale (IA) generativa, da ChatGPT in poi, poggiano su una massiccia infrastruttura di lavoro umano. Dietro i risultati che stupiscono per coerenza e naturalezza si cela infatti il lavoro gravoso e spesso invisibile dei "data labeller", persone incaricate di classificare, annotare e verificare migliaia di dati grezzi, comprese immagini di scene del crimine o conversazioni con chatbot su tematiche traumatiche.

Questa forza lavoro, essenziale per l'apprendimento automatico, opera in un regime di scarsissime tutele, con compensi che in alcuni casi sono stati paragonati alla "schiavitù moderna".

Il settore del data-labeling, che nel 2024 valeva 3,8 miliardi di dollari, è in rapida crescita e si prevede superi i 17 miliardi entro cinque anni. È un mercato che, per natura, delega compiti complessi a una "sottoclasse digitale", spesso composta da giovani lavoratori con un buon livello di istruzione in paesi a basso reddito. Il loro ruolo è critico: definiscono non solo gli input per i modelli di IA, ma anche la qualità e l'accuratezza degli output, intervenendo anche per evitare contenuti violenti o non etici.

Tuttavia, l'esposizione costante a materiale altamente traumatico, come cadaveri o istruzioni per atti violenti, ha causato problemi di salute mentale tra i lavoratori, i quali denunciano una mancanza di supporto adeguato.

Il prezzo della specializzazione e la lotta per i diritti

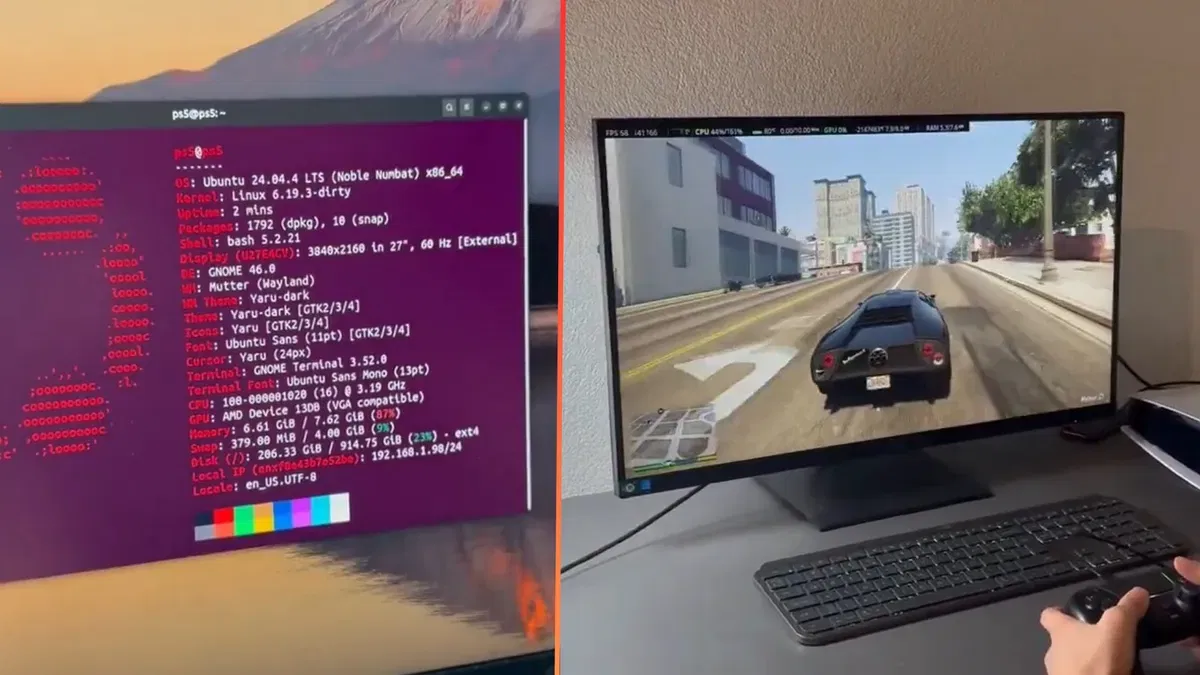

Mentre la tecnologia avanza e i modelli come ChatGPT diventano più sofisticati, la necessità di conoscenze specialistiche per informare e giudicare le loro risposte in ambiti come la chimica, la matematica o le lingue meno comuni aumenta.

Aziende come Scale AI, che ha tra i suoi clienti OpenAI e Microsoft, offrono paghe più alte, dai 30 ai 50 dollari all'ora, per esperti in materie specifiche. Ciononostante, la maggior parte dei "taskers" è inquadrata come collaboratore indipendente, priva di protezioni contrattuali e soggetta a licenziamenti improvvisi o alla mancata ricezione dello stipendio.

Iniziative come la Data Labelers Association (DLA) in Kenya spingono per l'adozione di un codice di condotta che includa contratti di lavoro, equo compenso e supporto psicologico. Le loro richieste, tuttavia, si scontrano con le pratiche delle grandi tech company che spesso si nascondono dietro subcontractor. Le azioni legali, tra cui diverse cause negli Stati Uniti contro Scale AI per presunto furto di salario e mancata classificazione dei lavoratori come dipendenti, sollevano un interrogativo cruciale sulla governance etica della filiera AI.

La stessa OpenAI, pur dichiarando di avere regole severe sui suoi subappaltatori in merito a sicurezza sul lavoro e retribuzione equa, opera in un contesto in cui il suo principale fornitore è stato citato in giudizio per le condizioni dei lavoratori. Il tema dei deepfake a sfondo sessuale è solo una delle conseguenze non etiche che si cercano di mitigare con questo lavoro umano.

L'angolo cieco della regolamentazione

La resistenza dei lavoratori a queste condizioni ha portato a episodi di ritorsione, come il licenziamento di quasi 250 dipendenti di un subappaltatori di Google. Questo dimostra come le aziende cerchino "annotatori docili", ostacolando la lotta sindacale per diritti basilari come ferie, malattie pagate e assistenza sanitaria.

Nonostante i tentativi di regolamentazione, anche in Europa, la legislazione sull'IA presenta ancora "lacune" che non menzionano esplicitamente i click worker.

È un paradosso: la ricerca di un'intelligenza artificiale sempre più umana e priva di bias (almeno nei nostri desideri) si traduce in un sistema che dipende da un lavoro disumanizzato e sfruttato. Fino a che punto possiamo ignorare la sofferenza nella catena di approvvigionamento dell'IA, prima che la questione etica si trasformi in un rischio reputazionale e legale insostenibile?