Nel competitivo settore dell'intelligenza artificiale, dove la qualità dei dati di addestramento rappresenta il vero vantaggio competitivo, emerge una pratica potenzialmente controversa. Secondo quanto riportato da Wired, OpenAI starebbe chiedendo ai propri collaboratori esterni di caricare documenti reali prodotti durante precedenti impieghi o attività lavorative in corso. Una strategia che ha sollevato immediatamente una serie di interrogativi sulla protezione della proprietà intellettuale e sulla riservatezza dei dati aziendali, ma che appare in linea con l'obiettivo dichiarato di addestrare modelli linguistici capaci di automatizzare mansioni sempre più complesse nei settori avanzati.

La pratica coinvolgerebbe OpenAI insieme a Handshake AI, società specializzata nella generazione di dati di addestramento. Documenti interni ottenuti dalla testata indicano che i contractor riceverebbero istruzioni esplicite per descrivere compiti svolti in altre organizzazioni e fornire esempi concreti del proprio lavoro. Non semplici riassunti o descrizioni testuali, ma file effettivi in formati standard come Word, PDF, PowerPoint, Excel, immagini o repository di codice.

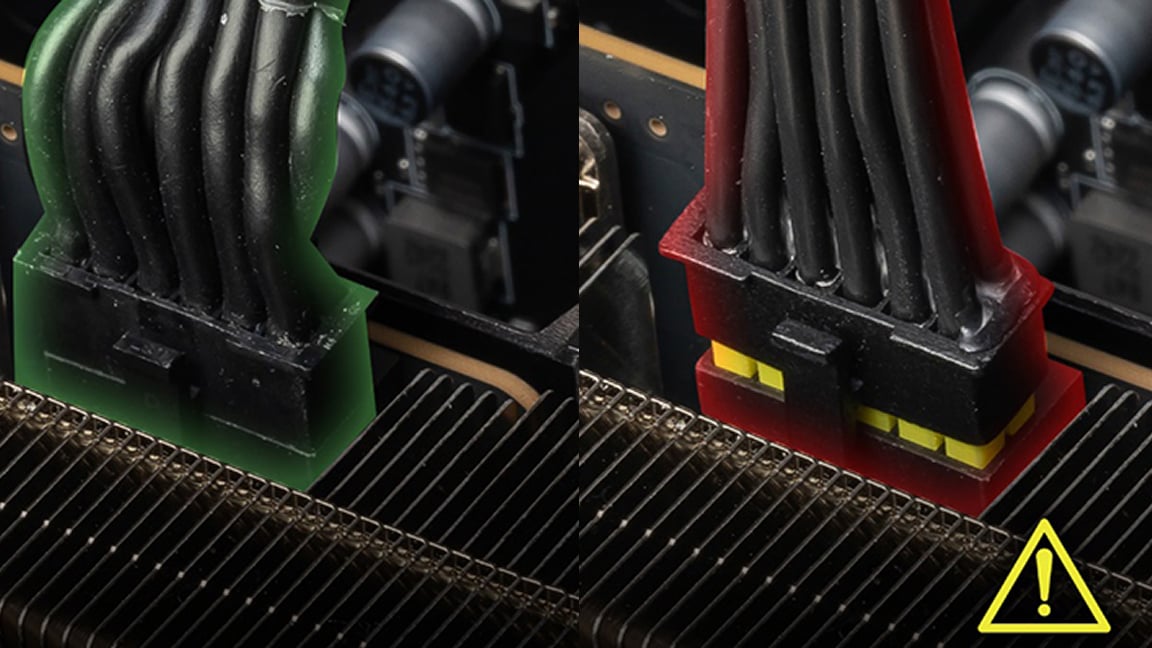

Il meccanismo prevede che i collaboratori rimuovano autonomamente informazioni proprietarie e dati personalmente identificabili prima del caricamento. Per facilitare questa operazione di pulizia, OpenAI avrebbe sviluppato uno strumento denominato "Superstar Scrubbing", accessibile attraverso ChatGPT stesso, che dovrebbe assistere nella rimozione automatica di contenuti sensibili dai documenti.

La strategia risponde a un'esigenza tecnica precisa: i modelli linguistici di nuova generazione necessitano di esempi concreti di lavoro professionale per apprendere le sfumature, i formati e le convenzioni specifiche di settore. Dataset sintetici o generati artificialmente, per quanto ampi, non riescono a catturare la complessità delle situazioni reali che consulenti, analisti, programmatori o manager affrontano quotidianamente. Documenti autentici prodotti in contesti lavorativi reali rappresentano quindi materiale preziosissimo per l'addestramento.

Tuttavia, l'approccio solleva preoccupazioni legali significative. Evan Brown, avvocato specializzato in proprietà intellettuale intervistato da Wired, ha espresso un giudizio critico: qualsiasi laboratorio di AI che adotti questa metodologia si esporrebbe a rischi considerevoli, affidandosi eccessivamente alla capacità dei singoli contractor di distinguere autonomamente ciò che è confidenziale da ciò che può essere condiviso. La questione diventa particolarmente delicata in settori regolamentati o dove gli accordi di riservatezza sono particolarmente stringenti.

In ambito europeo, le implicazioni potrebbero rivelarsi ancora più complesse. Il Regolamento Generale sulla Protezione dei Dati (GDPR) impone vincoli rigorosi sul trattamento di informazioni personali, mentre normative settoriali in ambito finanziario, sanitario o legale pongono ulteriori barriere alla condivisione di documentazione professionale. Un contractor europeo che caricasse documenti contenenti dati di clienti o informazioni aziendali sensibili potrebbe violare simultaneamente obblighi contrattuali, normative sulla privacy e leggi sulla protezione dei segreti commerciali.

OpenAI non ha rilasciato commenti ufficiali quando contattata dalla stampa statunitense per chiarimenti sulla vicenda. Questo silenzio si inserisce in un contesto più ampio di opacità che caratterizza le strategie di raccolta dati nell'industria dell'AI. Mentre le aziende del settore pubblicizzano l'adozione di pratiche etiche e responsabili, i dettagli operativi sulla provenienza dei dati di addestramento rimangono spesso avvolti dalla riservatezza commerciale.

La questione assume rilevanza particolare alla luce degli obiettivi dichiarati da OpenAI e dai principali competitor nel campo dell'intelligenza artificiale generativa. L'automazione di compiti d'ufficio complessi rappresenta il prossimo traguardo dopo il successo nell'elaborazione di testo, generazione di codice e analisi di dati strutturati. Modelli capaci di redigere analisi finanziarie, presentazioni strategiche o report legali con competenza professionale richiedono esposizione a migliaia di esempi reali, impossibili da replicare attraverso dati sintetici o simulazioni.

Resta da vedere se questa pratica diventerà standard nel settore o se le preoccupazioni legali spingeranno verso approcci alternativi, come partnership dirette con aziende disposte a condividere dataset sanitizzati o la generazione di ambienti di lavoro simulati ma realistici. Nel frattempo, professionisti e aziende farebbero bene a verificare attentamente gli accordi di riservatezza prima di autorizzare dipendenti o collaboratori a partecipare come contractor per progetti di addestramento AI.