Quando il Pentagono ha bussato alla porta di Anthropic chiedendo di rimuovere i filtri etici dal software Claude per usi militari, si è aperta una delle controversie principali nel mondo dell'intelligenza artificiale. La risposta iniziale di Dario Amodei, fondatore e amministratore delegato della società, è stata un no secco: niente sorveglianza di massa sul territorio americano, niente armi autonome capaci di scegliere i propri bersagli senza supervisione umana. Una presa di posizione che ha fatto di lui, per qualche giorno almeno, una sorta di eroe dell'etica tecnologica agli occhi di chi segue con preoccupazione il rapporto sempre più stretto tra intelligenza artificiale e apparato militare.

La storia, però, è durata poco. Nel giro di poche ore, Amodei è tornato sui propri passi aprendo a una trattativa con il Pentagono, dopo che l'amministrazione Trump lo aveva pubblicamente accusato di essere un fornitore inaffidabile e antiamericano, minacciando di rescindere i contratti. Un voltafaccia che ha ridimensionato notevolmente l'immagine del paladino etico, riportando tutto a una dimensione più prosaica: quella degli interessi economici di un'azienda che vale miliardi.

Il contesto in cui questa vicenda si inserisce è quello del conflitto in Iran, che ha riportato al centro dell'attenzione il ruolo crescente dell'intelligenza artificiale nelle operazioni militari. Non si tratta di fantascienza: gli eserciti moderni utilizzano già strumenti come ChatGPT, Gemini o Claude con la stessa naturalezza con cui li adoperiamo noi nella vita quotidiana. La tecnologia ha sempre rappresentato un vantaggio decisivo in guerra, dall'arco lungo degli arcieri inglesi medievali ai droni teleguidati. L'AI non è un'eccezione, è l'ultimo capitolo di questa storia.

Quello che sorprende, analizzando la vicenda con attenzione, è che la differenza tra Anthropic e OpenAI su questi temi sia in realtà molto meno netta di quanto i titoli dei giornali abbiano lasciato intendere. Anche OpenAI afferma di non voler consentire la sorveglianza di massa o lo sviluppo di armi completamente autonome. La distinzione è sottile: OpenAI dichiarava di essere disposta a fornire il software con vincoli integrati, mentre Amodei aveva imposto un divieto assoluto, almeno finché non ha cominciato a trattare. Una differenza di tono, più che di sostanza, che i media hanno amplificato fino a trasformarla in uno scontro epico tra il bene e il male.

Il boom di disinstallazioni di ChatGPT a favore di Claude, registrato nei giorni successivi alla dichiarazione di Amodei, racconta qualcosa di importante sul comportamento dei consumatori: tendiamo a identificarci con i valori dichiarati di un'azienda, a cercare in una multinazionale uno specchio dei nostri principi. È un errore, probabilmente strutturale. Una grande azienda tecnologica non è un'entità con cui si condivide una visione del mondo: è una persona giuridica che risponde a logiche di mercato, di responsabilità legale e di protezione del brand, non a imperativi morali.

C'è poi una questione di coerenza che vale la pena sollevare. L'etica selettiva, quella che si applica solo quando non costa nulla, non è davvero etica: è gestione dell'immagine. In questo senso, un'azienda come Palantir, che persegue apertamente una propria visione del mondo senza nascondersi dietro proclami di responsabilità sociale, offre almeno la trasparenza di sapere con chi si ha a che fare. Chi promette principi e poi li piega alla convenienza crea un'aspettativa che inevitabilmente delude.

Le due questioni sollevate da questa vicenda meritano però di essere affrontate nel merito, al di là delle dinamiche aziendali. La sorveglianza di massa è il primo grande nodo. Dotare uno Stato degli strumenti per monitorare ogni movimento di ogni cittadino significa costruire le fondamenta tecnologiche dell'autoritarismo. Non è fantascienza distopica: i regimi sovietici avevano già quella ambizione, ma non avevano gli strumenti per realizzarla. Oggi quegli strumenti esistono, e sono sempre più accessibili. George Orwell, scritto quasi ottant'anni fa, non ha mai smesso di essere attuale: la differenza è che il Grande Fratello del Novecento era limitato dalla tecnologia del suo tempo, quello contemporaneo non lo è più.

Il secondo nodo riguarda le armi autonome, quelle che i militari vorrebbero: sistemi capaci di identificare un bersaglio e colpirlo senza alcun intervento umano. Il principio del "human in the loop", cioè la necessità che un essere umano rimanga sempre nella catena decisionale, è stato ripetuto come un mantra da esperti e appassionati di AI. Ma i comandi militari sembrano persuasi che i sistemi attuali abbiano già raggiunto un livello di accuratezza sufficiente per operare in autonomia, con un "margine di errore accettabile". È proprio questa espressione a essere inquietante: chi stabilisce quante vittime civili sono accettabili? Quale algoritmo può portare il peso di una simile decisione?

Delegare alla macchina scelte di vita o di morte non è solo un problema tecnico, è un problema filosofico che non ha risposte preconfezionate. Il rischio concreto è che, una volta costruiti questi sistemi e dispiegati nei teatri di guerra, tornare indietro diventi impossibile. Certi rischi o li previeni o li subisci: quando si sono già materializzati, è troppo tardi per gestirli. L'Europa, spesso criticata per un approccio regolatorio considerato eccessivamente prudente rispetto alla corsa all'innovazione di Stati Uniti e Cina, ha almeno il merito di aver posto il problema in termini normativi prima che tecnologici.

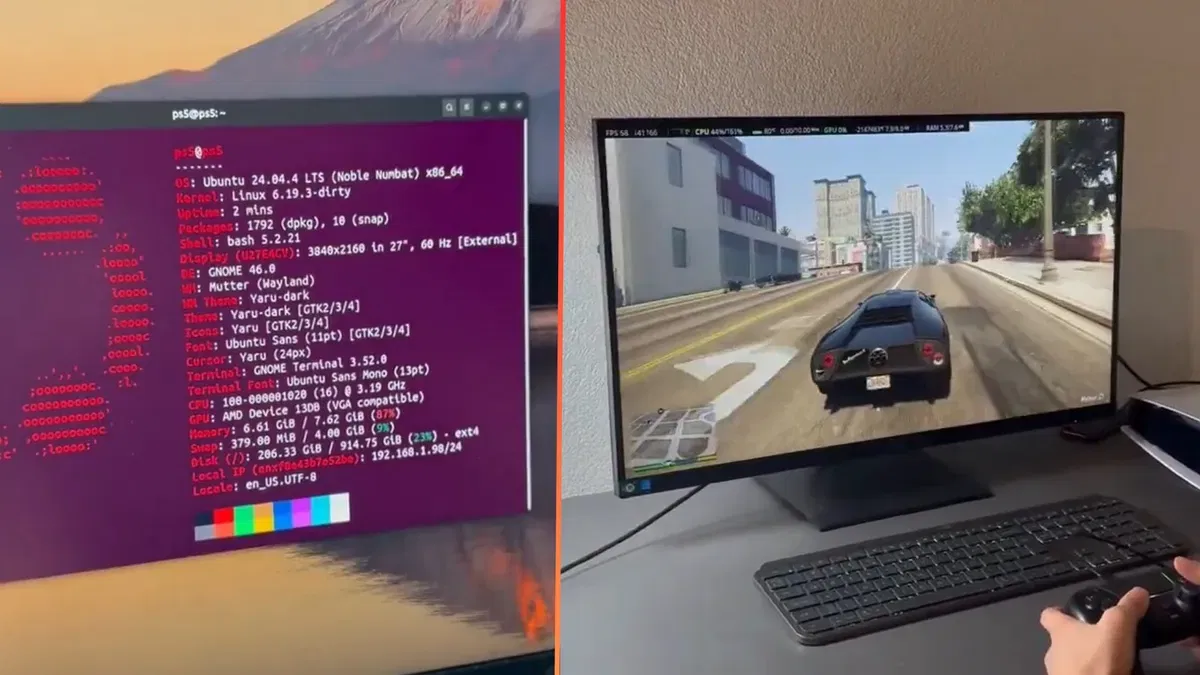

Nel frattempo, il mercato dell'AI continua a correre. OpenAI ha appena rilasciato GPT-5.4, poche settimane dopo la 5.3, in un ciclo di aggiornamenti sempre più accelerato che rende difficile persino tener traccia delle versioni. Questa frammentazione delle release, che un tempo erano eventi rari e significativi, racconta anche qualcos'altro: tutti i grandi player stanno sostanzialmente giocando la stessa partita, nessuno ha davvero intenzione di differenziarsi in modo radicale. E se tutti fanno la stessa cosa, le dichiarazioni etiche rischiano di restare quello che probabilmente sono: strumenti di marketing, non bussole morali.