Le aziende faticano a gestire i rischi dell'intelligenza artificiale perché i team di cybersecurity tradizionali non comprendono la natura linguistica e logica delle vulnerabilità dei nuovi modelli.

Sander Schulhoff, ricercatore esperto di vulnerabilità dei sistemi di intelligenza artificiale, ha lanciato un avvertimento chiaro e tondo: le attuali strutture di difesa aziendale sono del tutto impreparate ad affrontare i fallimenti dei modelli linguistici. E non si tratta di strumenti che si potrebbero comprare, quanto piuttosto di un un fondamentale errore di prospettiva nel comprendere questi sistemi.

Se nella sicurezza informatica classica il nemico è un errore nel codice che può essere corretto con una patch, infatti, nell'ambito dei Large Language Models (LLM) ci troviamo di fronte a una sfida di natura diversa, dove la manipolazione avviene attraverso il linguaggio e le istruzioni indirette.

Il limite del paradigma tradizionale

"Puoi rattoppare un bug, ma non puoi rattoppare un cervello", ha dichiarato Schulhoff per descrivere il disallineamento tra il modo in cui pensano i team di sicurezza e il modo in cui falliscono i modelli IA. Questa distinzione è cruciale: un esperto di cybersecurity può analizzare un sistema alla ricerca di falle tecniche, ma spesso non si pone la domanda fondamentale: "E se qualcuno ingannasse l'IA spingendola a fare qualcosa che non dovrebbe?". È il problema del prompt injection, al quale per ora possiamo rispondere solo con la mitigazione - ma a volte è piuttosto efficace.

Ne abbiamo parlato diverse volte, anche di recente, le AI non se la cavano molto bene in tema di sicurezza, e il punto è proprio che i problemi sono “by design” e la soluzione richiede necessariamente un approccio diverso; ma la capacità di mediare tra competenze ingegneristiche e comprensione dei bias logici è ancora merce rara.

Schulhoff sottolinea come le competenze del futuro risiedano proprio nell'intersezione tra la sicurezza informatica classica e la conoscenza profonda dei modelli IA, ad esempio sapendo quando isolare l'output di un'intelligenza artificiale in un container per evitare che codice malevolo generato per errore comprometta l'intera infrastruttura.

Il miraggio delle soluzioni preconfezionate

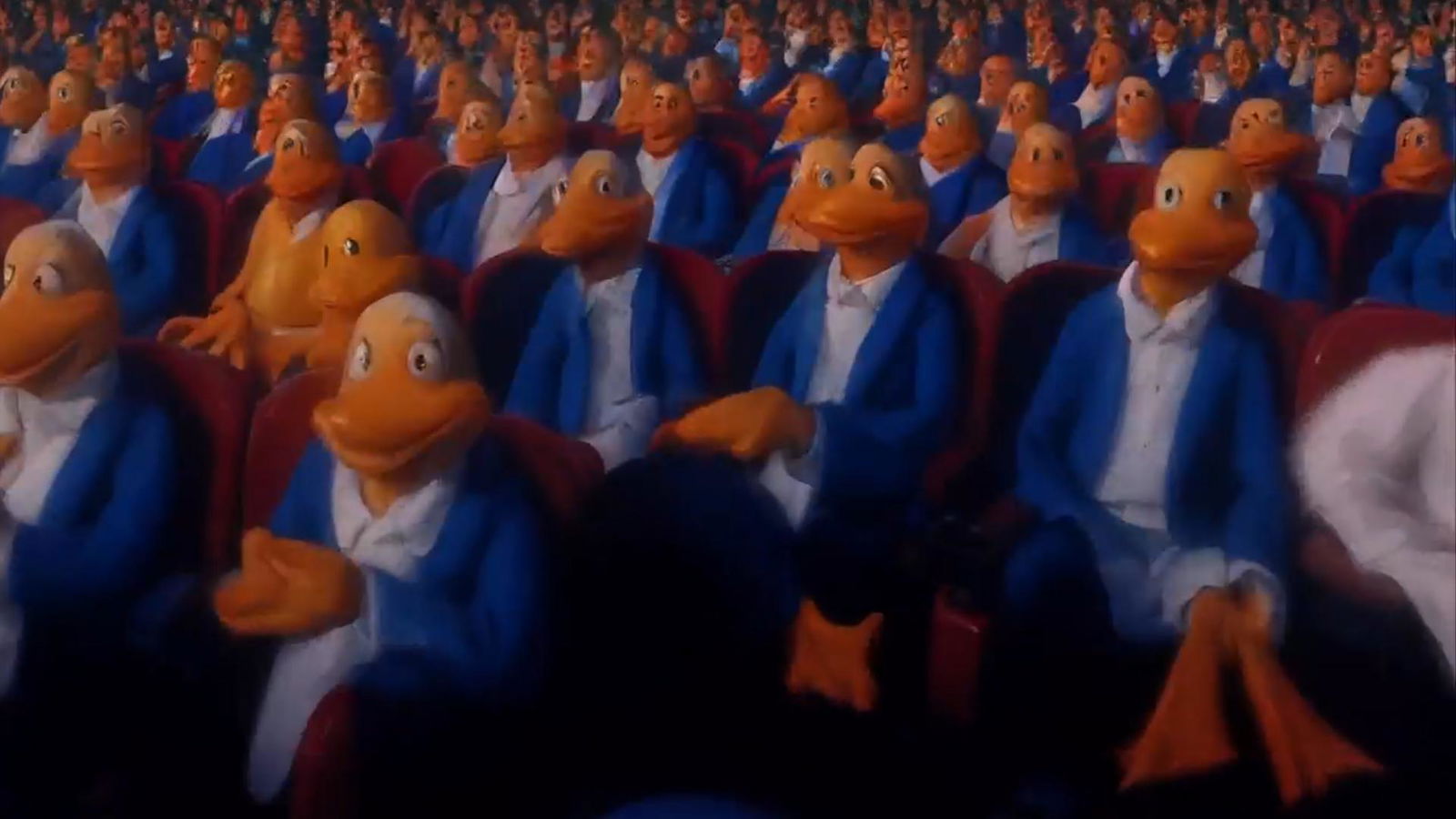

Un altro punto critico sollevato dal ricercatore riguarda la proliferazione di startup che promettono "guardrail" universali. Schulhoff definisce queste promesse come fuorvianti, prevedendo una correzione di mercato per quelle aziende che vendono strumenti automatizzati di red-teaming incapaci di coprire l'infinità di modi in cui un'IA può essere manipolata.

Nonostante gli investimenti miliardari, come dimostra la recente acquisizione di Wiz da parte della Google, la tecnologia da sola non basta. La vera sicurezza richiede una visione culturale che spinga le aziende ad andare oltre il semplice consumo di strumenti pronti all'uso, investendo invece nel reskilling del personale per comprendere la logica di questi nuovi "cervelli" digitali.

Il rischio reale maggiore finisce quindi per l'eccessiva fiducia in sistemi che non comprendiamo appieno. Usarli è doveroso, e probabilmente non possiamo più immaginare un mondo senza IA; ma è altrettanto doveroso usarli con criterio.

La domanda che ogni manager dovrebbe porsi oggi non è quanti software di protezione ha acquistato, ma quante persone nel suo team sanno distinguere un errore di codice da una manipolazione logica dell'IA.