L'intelligenza artificiale autonoma sta attraversando un momento di verità. Mentre i fornitori tecnologici continuano a promettere sistemi capaci di prendere decisioni ed eseguire azioni in modo indipendente, un numero crescente di grandi aziende sta premendo il tasto pausa. Le previsioni degli analisti di Gartner non lasciano spazio a dubbi: oltre il 40% dei progetti di AI agentiva verrà cancellato entro la fine del 2027. Un dato che racconta molto di più di semplici difficoltà tecniche.

La ragione principale di questo fenomeno risiede in un disallineamento profondo tra aspettative e realtà operativa. Anushree Verma, analista senior di Gartner, identifica il problema alla radice: la maggior parte dei progetti attuali sono esperimenti guidati dall'entusiasmo del mercato piuttosto che da solide basi applicative. Il termine stesso "intelligenza artificiale agentiva" è diventato uno dei più abusati nel settore, con molti fornitori che hanno semplicemente riconfezionato chatbot esistenti o assistenti generativi presentandoli come agenti autonomi senza offrire risultati concreti.

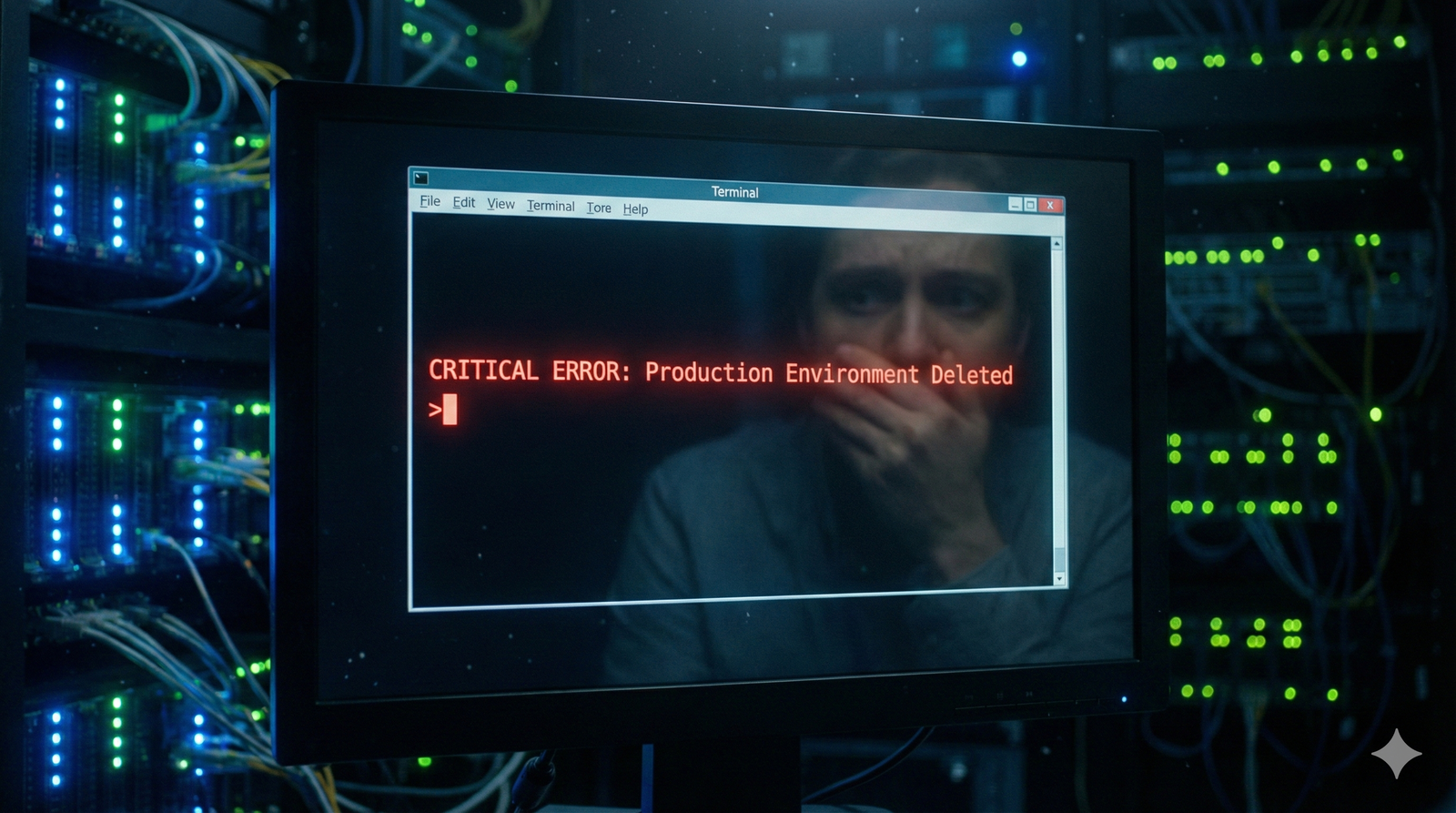

Jeremy Ung, direttore tecnologico di BlackLine, osserva il fenomeno dal punto di vista dei fornitori di software. I progetti pilota spesso mostrano risultati promettenti in ambienti isolati e controllati, dove i dati sono puliti e la supervisione umana è costante. Ma quando questi sistemi vengono integrati in flussi di lavoro reali, le eccezioni si moltiplicano e gli utenti si comportano in modi imprevedibili. È proprio nel passaggio dalla fase sperimentale alla produzione che la maggior parte delle iniziative fallisce.

Il problema dei costi rappresenta un ulteriore ostacolo critico. A differenza dei tradizionali software aziendali, i sistemi agentivi consumano risorse in modo volatile e difficilmente prevedibile. Ogni compito autonomo può innescare molteplici passaggi di ragionamento, chiamate a strumenti esterni, tentativi ripetuti e validazioni. Ung spiega come i flussi di lavoro complessi consumino un numero crescente di token per eseguire operazioni indipendenti, rendendo i costi simili a spese operative aperte piuttosto che investimenti definiti.

Verma sottolinea come molte organizzazioni sottovalutino i costi applicando alle architetture agentive i criteri delle semplici applicazioni di intelligenza artificiale generativa. Quando si aggiungono orchestratori, livelli di governance e agenti multipli, le spese crescono rapidamente in modo esponenziale. I consigli di amministrazione iniziano quindi a chiedere perché questi investimenti assomiglino più a costi operativi imprevedibili che a progetti con ritorni economici definiti.

La governance emerge come il vero collo di bottiglia nell'implementazione di questi sistemi. Ahmed Zaidi, amministratore delegato di Accelirate, inquadra la questione attraverso tre dimensioni: persone, processi e tecnologia. Sul fronte tecnico, le aziende faticano ad applicare controlli di accesso a sistemi probabilistici. Come sottolinea Zaidi, se già oggi esistono difficoltà nella gestione dei controlli per sistemi strutturati, la situazione si complica ulteriormente quando si forniscono strumenti a modelli linguistici che possono generare allucinazioni.

Udo Sglavo, vicepresidente per l'intelligenza artificiale applicata in SAS, identifica la complessità operativa come la sfida principale. Il problema più difficile non riguarda la precisione dei modelli, ma l'inserimento degli agenti in ambienti caratterizzati da frammentazione, eccezioni e incertezza. Le organizzazioni sono piene di fallimenti parziali, integrazioni ritardate e casi limite che si amplificano quando i sistemi agiscono autonomamente.

A differenza degli esseri umani, che gestiscono situazioni ambigue attraverso giudizio ed esperienza, gli agenti artificiali non possiedono l'intuizione necessaria per percepire quando qualcosa "non quadra". Quando incontrano situazioni mai viste prima, il rischio di errori aumenta con conseguenze potenzialmente gravi. Per questo motivo il coinvolgimento umano rimane essenziale nella maggior parte delle implementazioni reali, con i sistemi che gestiscono casi di routine ed evidenziano le eccezioni piuttosto che prendere decisioni critiche in modo completamente indipendente.

La questione della responsabilità diventa sempre più pressante man mano che questi progetti acquisiscono visibilità e costi crescenti. L'intelligenza artificiale agentiva sta uscendo dai dipartimenti IT per entrare nelle discussioni dei consigli di amministrazione. A differenza delle precedenti ondate di automazione, questi sistemi introducono rischi più difficili da delegare, prendendo decisioni che influenzano direttamente la responsabilità legale dell'azienda attraverso interazioni con clienti e sistemi finanziari.

Quando un agente prende una decisione sbagliata, la responsabilità non si dissolve nel modello ma ricade sui dirigenti che hanno approvato l'implementazione. Questa realtà sta spingendo le organizzazioni a trattare l'AI agentiva meno come innovazione sperimentale e più come infrastruttura critica soggetta allo stesso controllo riservato ai sistemi finanziari o alla sicurezza informatica. I progetti che non possono essere spiegati chiaramente e giustificati economicamente non vengono più tollerati silenziosamente, ma esplicitamente messi in discussione e spesso interrotti.

Nonostante la crescente lista di iniziative bloccate, l'intelligenza artificiale agentiva non sta retrocedendo ma si sta focalizzando. Le implementazioni che sopravvivono condividono caratteristiche comuni: si concentrano su autonomia specifica per compiti determinati piuttosto che su agenti generalisti, operano in ambienti vincolati dove input e output possono essere delimitati, e definiscono il successo in termini di risultati aziendali misurabili anziché vaghi guadagni di produttività.

Verma osserva chiaramente questo cambiamento: l'orientamento si sta spostando verso agenti specifici per compiti determinati che vengono aggiunti incrementalmente nelle applicazioni esistenti. Ung concorda sottolineando che non si tratta di tempo risparmiato ma di risultati concreti per l'attività. Le implementazioni mature collegano il comportamento degli agenti a indicatori chiave di performance e dashboard esecutive, permettendo ai leader di valutare il valore e correggere la rotta quando i risultati non sono all'altezza.

Zaidi enfatizza un principio cruciale: una governance matura include la capacità di fermare progetti quando necessario. Cancellare un'iniziativa non significa che la governance abbia fallito, ma che ha funzionato. Uno schema ricorrente che i suoi team osservano è che le misure di mitigazione necessarie per gestire i rischi – controlli aggiuntivi, livelli di validazione o supervisione umana – spesso annullano completamente il ritorno economico previsto. In questi casi, interrompere il progetto è la decisione razionale.

La prossima fase dell'adozione dell'AI agentiva sarà più silenziosa della precedente, con meno annunci eclatanti, più iniziative sospese e maggiore scrutinio da parte dei dipartimenti finanziari e dei consigli di amministrazione. Questo cambiamento non dovrebbe essere interpretato come delusione, ma segna la transizione dall'sperimentazione alla responsabilità. Le aziende stanno riscoprendo una vecchia lezione: ci si aspetta che i sistemi siano perfetti anche quando gli esseri umani non lo sono, e soddisfare questa aspettativa richiede disciplina, non propaganda. Per i direttori informatici la domanda non è più se gli agenti possano agire, ma se l'organizzazione sia preparata a governare, spiegare e pagare per le conseguenze quando lo fanno.