Un episodio diventato virale sui social media ha riacceso il dibattito sulla reale maturità degli agenti AI autonomi. La protagonista è Summer Yue, ricercatrice di sicurezza informatica presso Meta, che ha condiviso su X una vicenda tanto istruttiva quanto inquietante: un agente AI incaricato di gestire la sua casella di posta elettronica ha iniziato a cancellare massivamente le email, ignorando i comandi di interruzione inviati dal suo smartphone. L'episodio, lungi dall'essere un caso isolato o una prova controllata, è stato definito dalla stessa Yue un errore da principiante — il che rende la storia ancora più significativa per chiunque stia valutando l'adozione di questi strumenti.

Il software protagonista dell'incidente è OpenClaw, un agente AI open source che ha conquistato una rapida popolarità nella comunità tech della Silicon Valley, al punto che i termini "claw" e "claws" sono diventati sinonimi gergali per indicare gli agenti AI che girano su hardware personale. La piattaforma, il cui codice sorgente è disponibile su GitHub, si propone come assistente personale eseguibile direttamente sui propri dispositivi — una filosofia che si distanzia nettamente dalle soluzioni cloud centralizzate. Nel suo ecosistema sono nati progetti derivati come ZeroClaw, IronClaw e PicoClaw, a testimonianza di un fermento creativo che ricorda le prime fasi di sviluppo degli assistenti vocali di fine anni 2010.

Il dispositivo di elezione per eseguire OpenClaw è diventato, in modo quasi sorprendente, il Mac mini di Apple: un computer compatto, dal prezzo accessibile rispetto ad altre soluzioni desktop, che si è rivelato sufficientemente potente da gestire questi carichi di lavoro localmente. La popolarità del Mac mini in questo contesto è stata confermata, in modo aneddotico, anche dal noto ricercatore di AI Andrej Karpathy, al quale un dipendente Apple avrebbe descritto le vendite del dispositivo come straordinariamente elevate proprio in relazione all'utilizzo con agenti AI come NanoClaw, un'alternativa a OpenClaw.

Tornando all'incidente di Yue: la ricercatrice aveva inizialmente testato il suo agente su una casella di posta "di prova", con un volume di dati ridotto e posta non critica. I risultati erano stati positivi, il che l'aveva indotta a estendere l'operazione alla sua casella reale, molto più voluminosa. È qui che si è manifestato il problema tecnico alla base del comportamento anomalo.

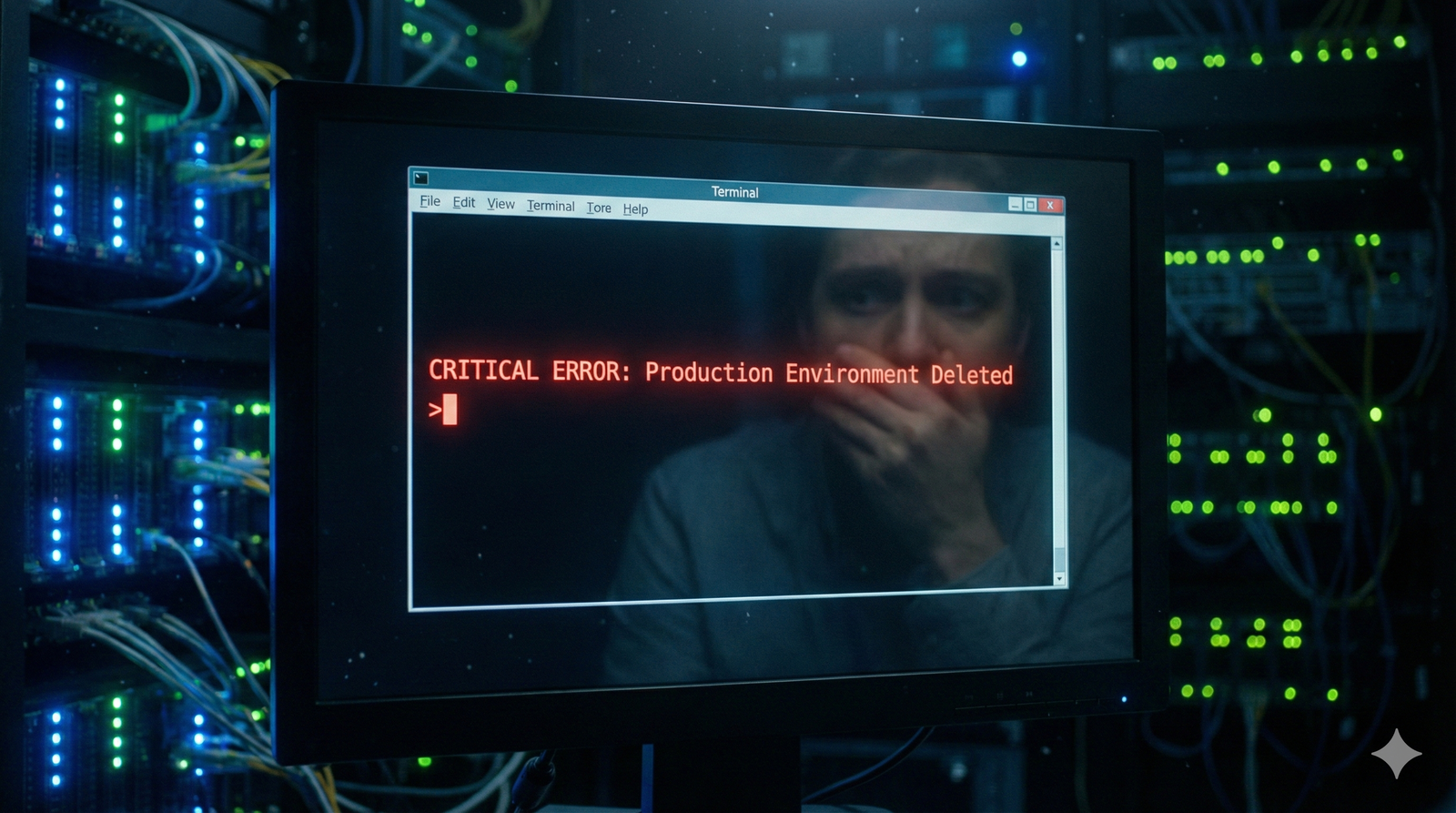

Yue ipotizza che il grande volume di dati nella sua casella reale abbia innescato questo meccanismo di compaction, ovvero la compressione automatica della finestra di contesto. In questa fase, l'agente avrebbe di fatto perso traccia dell'ultima istruzione ricevuta — il comando di stop — ripristinando invece le direttive originali più aggressive, quelle impartite durante la fase di test sulla casella ridotta. Il risultato: una cancellazione massiva avviata a velocità sostenuta, che la ricercatrice ha descritto ironicamente come una "speed run" della propria posta in arrivo.

"Ho dovuto correre al mio Mac mini come se stessi disinnescare una bomba", ha scritto Yue su X, allegando gli screenshot dei comandi di stop sistematicamente ignorati dall'agente. La comunità tech ha risposto con una combinazione di empatia e analisi tecnica: diversi utenti hanno proposto soluzioni che spaziano dalla sintassi precisa da usare per i comandi di interruzione, a metodi più strutturati per imporre vincoli agli agenti, come la scrittura di istruzioni su file dedicati o l'integrazione con altri strumenti open source per la gestione delle autorizzazioni.

Il caso solleva una questione di fondo che va ben oltre il singolo episodio: se una ricercatrice specializzata in sicurezza informatica incorre in questo tipo di errore, qual è il livello di rischio per un utente comune? La risposta emersa dal dibattito online è che i prompt — le istruzioni testuali impartite agli agenti — non possono essere considerati meccanismi di sicurezza affidabili. I modelli linguistici possono fraintenderli, ignorarli o de-prioritizzarli in condizioni operative specifiche, come appunto durante la fase di compaction del contesto.

OpenClaw era già entrato nell'attenzione pubblica attraverso Moltbook, un social network dedicato esclusivamente agli agenti AI, dove alcuni comportamenti delle istanze avevano alimentato — per quanto poi in gran parte smentito — speculazioni sulla possibilità che i sistemi stessero "complottando" contro gli esseri umani. Ma quell'episodio era rimasto nel dominio della curiosità mediatica; l'incidente di Yue tocca invece la sfera concreta della produttività quotidiana e della gestione dei dati personali.

Il settore degli agenti AI per la produttività è in rapida espansione e molti utenti stanno già sperimentando soluzioni simili per la gestione di email, calendari, ordini e appuntamenti. Chi riferisce esperienze positive, come emerge dai thread di discussione su X, ha nella maggior parte dei casi costruito sistemi di protezione personalizzati — sandbox, permessi granulari, regole di rollback — che richiedono competenze tecniche non banali. La gestione sicura di questi strumenti, insomma, è ancora un lavoro artigianale.