Nel mondo sempre più competitivo dell'intelligenza artificiale, le accuse di pratiche scorrette tra aziende concorrenti stanno diventando un tema ricorrente e sempre più urgente. Anthropic, la società americana che sviluppa il chatbot Claude, ha lanciato un'accusa formale e documentata contro tre aziende di intelligenza artificiale cinesi: DeepSeek, Moonshot e MiniMax. Secondo quanto pubblicato direttamente sul sito ufficiale di Anthropic, queste società avrebbero orchestrato campagne su scala industriale per estrarre illecitamente le capacità di Claude allo scopo di migliorare i propri modelli. Si tratta di un caso che tocca al cuore questioni fondamentali di proprietà intellettuale, sicurezza dei sistemi AI e concorrenza sleale nel settore tecnologico.

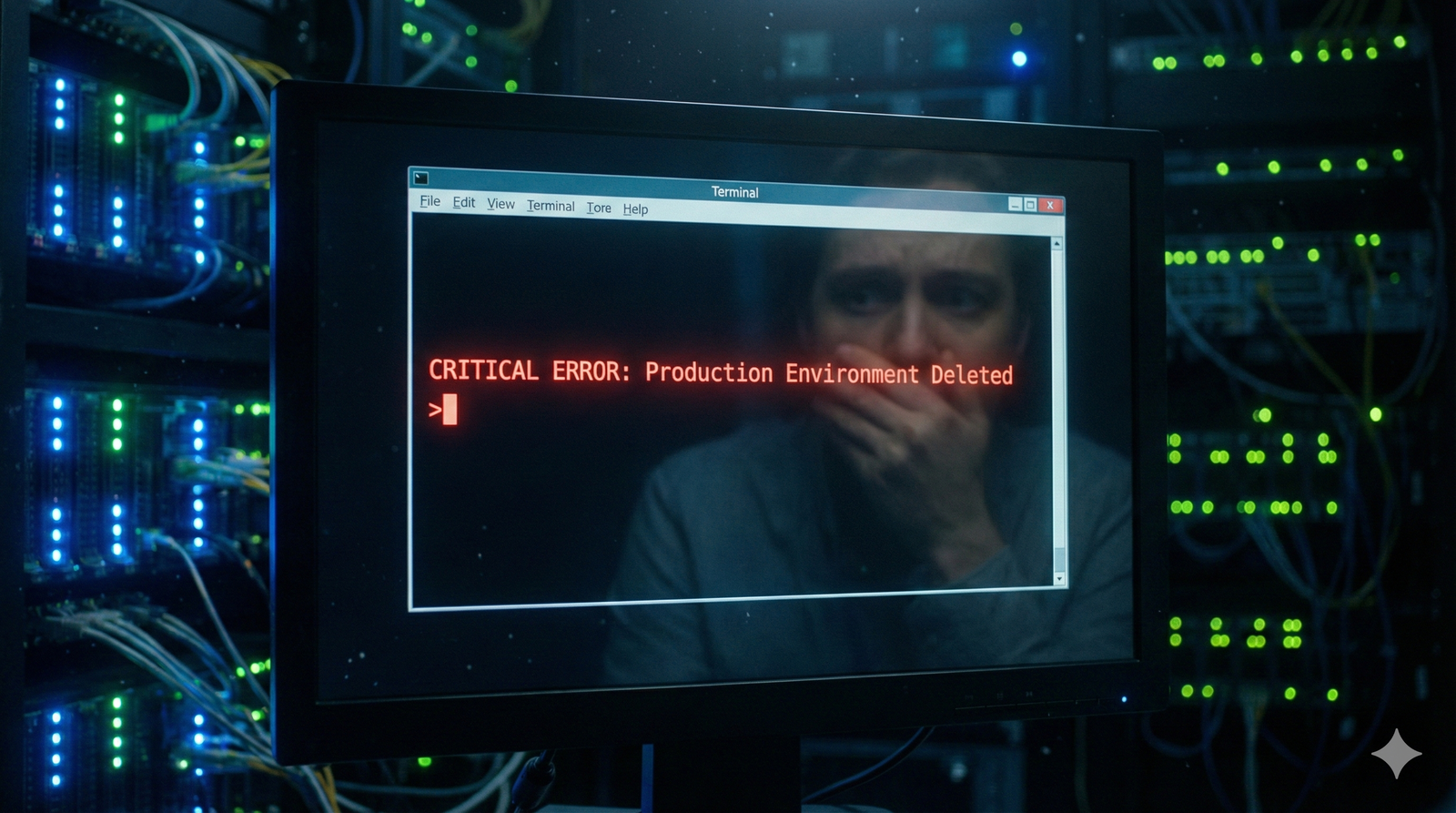

Il meccanismo al centro della disputa è noto nel settore come "distillazione" (in inglese knowledge distillation): una tecnica per cui modelli meno capaci si addestrano sfruttando le risposte generate da modelli più potenti, assorbendone indirettamente le capacità. Non si tratta di una pratica intrinsecamente illegale — la distillazione è un metodo legittimo e diffuso nella ricerca sull'AI — ma diventa problematica quando viene condotta senza autorizzazione e in violazione dei termini di utilizzo del servizio. In questo caso specifico, Anthropic afferma che le tre aziende avrebbero operato attraverso circa 24.000 account fraudolenti, generando più di 16 milioni di scambi con Claude.

L'aspetto tecnico più rilevante di questa vicenda riguarda la metodologia investigativa adottata da Anthropic per identificare i responsabili. La società ha dichiarato di aver collegato ciascuna campagna di distillazione alle specifiche aziende con alto grado di certezza, incrociando dati quali la correlazione degli indirizzi IP, i metadati delle richieste e gli indicatori infrastrutturali. Anthropic ha inoltre fatto riferimento a riscontri indipendenti provenienti da altri attori del settore che avrebbero osservato comportamenti analoghi, rafforzando così la robustezza delle proprie conclusioni.

Un ulteriore rischio sollevato da Anthropic riguarda le implicazioni sulla sicurezza: questo tipo di estrazione massiva delle capacità del modello potrebbe consentire alle aziende coinvolte non solo di replicare le prestazioni di Claude, ma anche di aggirare le misure di sicurezza e i meccanismi di salvaguardia integrati nel sistema. Si tratta di una preoccupazione concreta, dato che i modelli linguistici di grandi dimensioni (LLM) incorporano complessi sistemi di allineamento etico e filtri di contenuto che richiedono anni di sviluppo.

Il precedente in questo tipo di controversie è stato stabilito da OpenAI, che all'inizio del 2025 aveva già mosso accuse simili nei confronti di aziende rivali accusate di distillare i propri modelli, procedendo al blocco degli account sospetti. Anthropic sembra ora seguire una traiettoria analoga, ma con un approccio che punta anche sul rafforzamento tecnico delle difese: la società ha annunciato l'intenzione di aggiornare i propri sistemi per rendere gli attacchi di distillazione più difficili da eseguire e più facili da individuare in tempo reale.

Vale la pena contestualizzare questa vicenda all'interno di una situazione più articolata per Anthropic stessa: la società è attualmente oggetto di una causa legale promossa da alcune case editrici musicali, che accusano l'azienda di aver utilizzato testi di canzoni protetti da copyright per addestrare Claude senza le dovute autorizzazioni. Una dinamica che rende il quadro complessivo più complesso, poiché Anthropic si trova simultaneamente nella posizione di accusatore e accusato in materia di utilizzo non autorizzato di contenuti protetti.