Alibaba Cloud ha recentemente pubblicato uno studio accademico che illustra come sia riuscita a ridurre dell'82 per cento il numero di processori grafici necessari per gestire i modelli meno richiesti dai clienti. Si tratta di un risultato significativo dal punto di vista operativo, ma che non rappresenta quella rivoluzione tecnologica capace di scuotere i mercati come accaduto con il "momento DeepSeek" dello scorso gennaio.

Il documento tecnico, intitolato "Aegaeon: Effective GPU Pooling for Concurrent LLM Serving on the Market" e presentato al prestigioso simposio ACM SIGOPS sui principi dei sistemi operativi, parte da un'osservazione sorprendente. Nonostante la piattaforma Hugging Face ospiti oltre un milione di modelli di intelligenza artificiale, i clienti ne utilizzano effettivamente solo una manciata. Questa disparità crea un problema logistico enorme per i fornitori di servizi cloud.

Prima dell'implementazione di Aegaeon, Alibaba Cloud si trovava in una situazione paradossale: dedicava il 17,7 per cento dell'intera flotta di GPU per soddisfare appena l'1,35 per cento delle richieste dei clienti. La causa di questa inefficienza risiede nelle limitazioni tecniche dei processori grafici tradizionali, che possono ospitare contemporaneamente solo due o tre modelli a causa delle restrizioni di memoria. Questo approccio convenzionale comportava che migliaia di GPU rimanessero inattive, dedicate esclusivamente a modelli raramente utilizzati.

Per un'azienda come Alibaba, operante sotto le sanzioni statunitensi che limitano l'accesso ai chip di Nvidia e AMD, questa inefficienza diventava ancora più insostenibile. Il costo elevato delle GPU e le difficoltà di approvvigionamento hanno spinto il colosso cinese a sviluppare una soluzione alternativa basata sul pooling delle risorse grafiche e su tecniche avanzate di gestione della memoria.

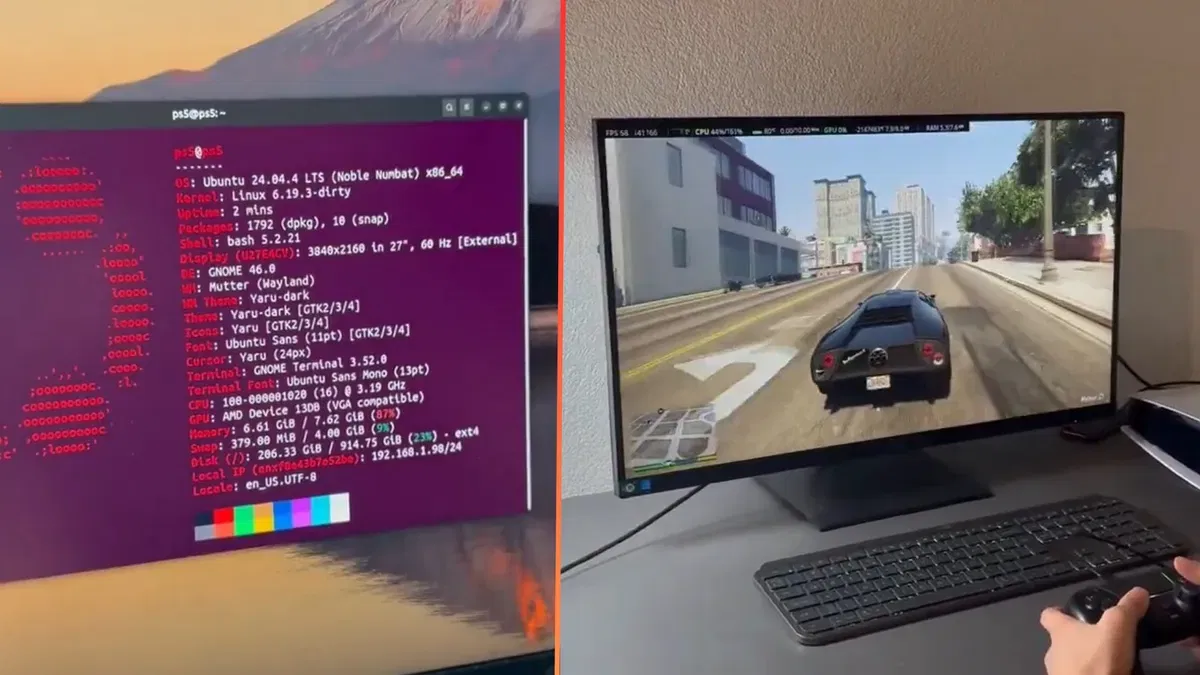

La tecnologia Aegaeon permette di eseguire decine di modelli contemporaneamente su ciascuna GPU, scaricando i dati nella memoria del sistema host o in altri dispositivi di archiviazione quando necessario. Durante i tre mesi di test beta, Alibaba è riuscita a ridurre da 1.192 a sole 213 le GPU necessarie per gestire i modelli meno utilizzati, mantenendo inalterata la qualità del servizio. Alcuni processori grafici sono ora in grado di eseguire simultaneamente decine di modelli diversi, un risultato impensabile con l'architettura precedente.

Sebbene l'azienda cinese sostenga che Aegaeon sia superiore alle soluzioni alternative e l'accettazione del paper da parte di una conferenza accademica di prestigio ne confermi la validità scientifica, rimane una questione aperta. Gli altri hyperscaler globali notoriamente non rivelano i dettagli delle tecnologie che alimentano le loro piattaforme, quindi è plausibile che abbiano già affrontato e risolto problematiche simili, magari con risultati ancora migliori.

Dunque, la "novità" di Alibaba magari non è affatto una novità.

Un aspetto interessante emerge dall'analisi del documento: i fornitori di servizi cloud sono tradizionalmente maestri nell'ottimizzare i tassi di utilizzo dell'hardware, poiché questa pratica impatta direttamente sulla redditività. Il fatto che Alibaba abbia pubblicato questo studio rivela indirettamente che la configurazione precedente dell'azienda non era particolarmente efficiente, suggerendo margini di miglioramento rispetto alla concorrenza occidentale.

L'importanza reale di questa ricerca va comunque oltre i numeri puri. Con la maturazione dell'ecosistema dell'intelligenza artificiale, gli sviluppatori stanno creando modelli sempre più specifici per settori industriali particolari o scenari d'uso verticali. I servizi cloud devono essere in grado di eseguirli tutti in modo efficiente, senza che i costi per utilizzare modelli di nicchia diventino proibitivi a causa dell'impiego inefficiente delle risorse GPU. L'approccio di Alibaba suggerisce che l'azienda sta compiendo progressi concreti in questa direzione.

Tuttavia, questo sviluppo non provocherà il panico tra gli investitori del settore AI come accadde quando DeepSeek dimostrò di poter ridurre drasticamente le quantità di GPU necessarie per l'addestramento dei modelli. Si tratta piuttosto di un'evoluzione incrementale nell'ottimizzazione delle risorse esistenti, un miglioramento operativo significativo ma non rivoluzionario nel panorama competitivo dell'intelligenza artificiale globale.