La sicurezza digitale all'alba del 2025 si trova davanti a un bivio critico, dove l'intelligenza artificiale rappresenta contemporaneamente la più grande minaccia e la più promettente soluzione. Con i costi globali del cybercrime che si avvicinano alla cifra record di 10 trilioni di dollari, i criminali informatici stanno affinando strategie sempre più sofisticate, sfruttando le vulnerabilità di un mondo sempre più interconnesso. In questo scenario, l'elemento umano rimane il principale anello debole della catena di sicurezza, con l'AI che amplifica esponenzialmente la capacità degli attacchi di sembrare autentici e personalizzati.

L'inganno perfetto: quando l'AI diventa un'arma

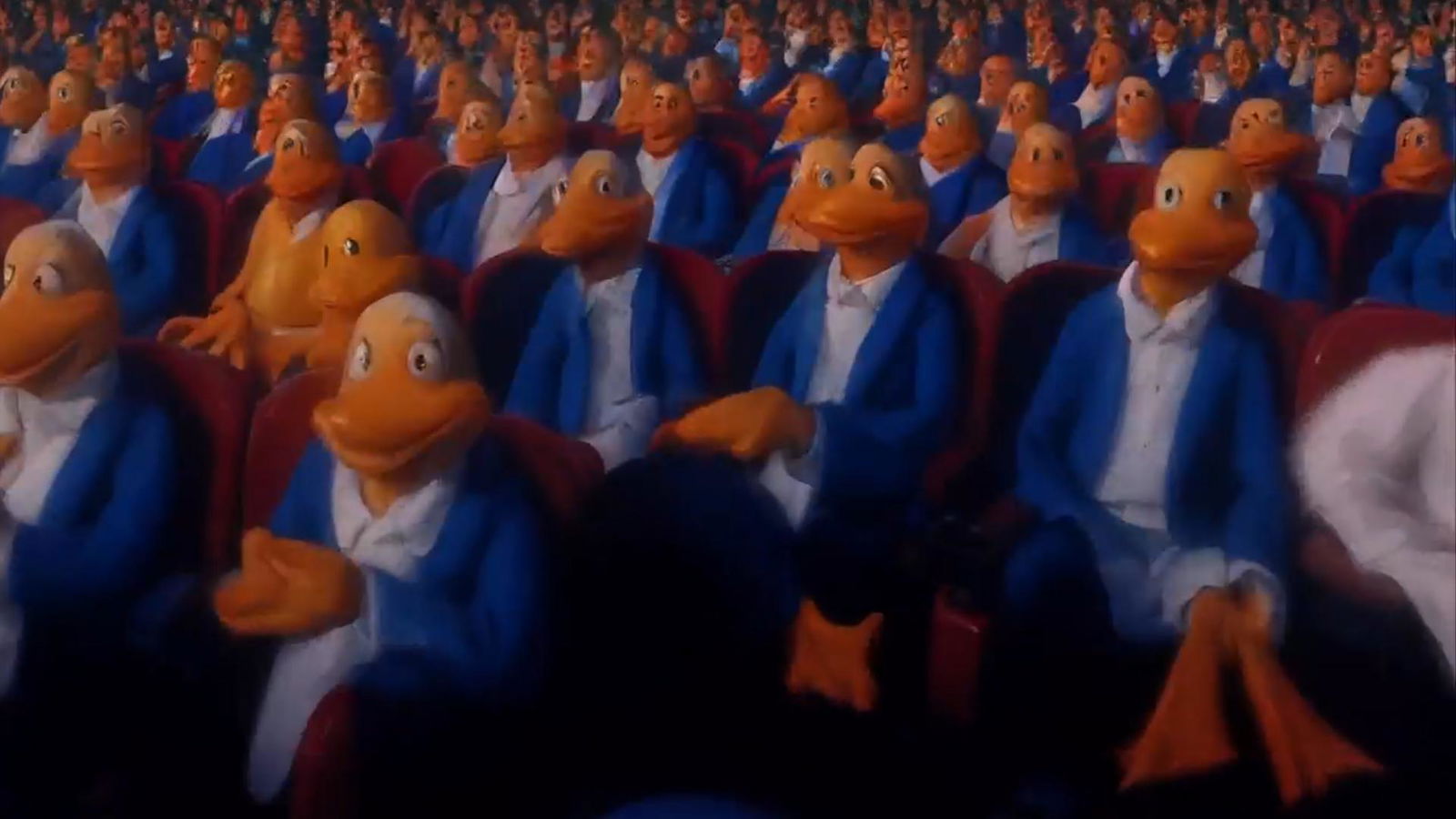

I deepfake rappresenteranno la minaccia più significativa nel panorama della sicurezza informatica del 2025. La capacità di questi strumenti di replicare in modo convincente voci, volti e persino stili di scrittura sta evolvendo a ritmi vertiginosi. I criminali informatici possono ora addestrare modelli linguistici avanzati sui contenuti pubblici di una persona per imitare perfettamente il suo stile comunicativo, conoscenze e personalità, creando impersonificazioni pericolosamente credibili.

Le truffe tradizionali come il Business Email Compromise (BEC) e le frodi basate su falsi dipendenti diventeranno ancora più insidiose grazie a questa tecnologia. Per le aziende, questi attacchi rappresentano un rischio primario, con conseguenze potenzialmente devastanti sia economiche che reputazionali.

Un'altra area in crescita è il "Bypass-KYC-as-a-service", un servizio nel mercato criminale che permette di aggirare i sistemi di verifica dell'identità sfruttando tre elementi: dati biometrici esposti involontariamente, informazioni personali trafugate (soprattutto da attacchi ransomware) e le capacità in espansione dell'AI.

Agenti autonomi: la nuova frontiera della vulnerabilità

Man mano che le aziende adottano agenti AI autonomi per rimanere competitive, emergono nuovi rischi difficilmente rilevabili con i metodi tradizionali. Questi agenti, dotati di autonomia decisionale, possono interagire con sistemi e dati aziendali creando catene di eventi invisibili agli operatori umani. Questa mancanza di visibilità rappresenta una seria preoccupazione per la sicurezza, poiché diventa difficile monitorare e controllare le azioni degli agenti in tempo reale.

Gli agenti AI potrebbero diventare bersagli privilegiati per gli autori di malware, con potenziale per attività non autorizzate o dannose, incluso il "dirottamento dell'agente" da parte di attori esterni. Il consumo di risorse di sistema da parte di questi agenti, che siano benigni o malevoli, può anche portare a denial-of-service quando le risorse vengono sovraccaricate.

Le aziende che adottano agenti AI devono essere particolarmente caute riguardo a violazioni di dati causate da errori di codifica, attacchi DDoS basati sull'infrastruttura e compromissioni da librerie o codice di terze parti. Il numero limitato di fornitori di agenti e modelli significa anche che un difetto in un provider popolare può creare una vulnerabilità persistente in numerose organizzazioni.

Il futuro del ransomware e delle tecniche di attacco

Il 2024 ha visto un aumento dei gruppi ransomware che sfruttano strumenti legittimi per l'esfiltrazione di dati, la raccolta di credenziali e la replica. Nel 2025, gli strumenti legittimi continueranno a essere sfruttati poiché i criminali informatici si rendono conto del loro potenziale nel mascherare l'attività di attacco come legittima.

Con l'aumento degli attacchi ransomware che iniziano attraverso vulnerabilità o utilizzando account compromessi, gli attacchi che iniziano con il phishing probabilmente diminuiranno, suggerendo un cambiamento nelle tecniche. Gli attacchi ransomware potrebbero anche spostarsi verso modelli di business che non richiedono più la crittografia.

Mentre i criminali informatici massimizzano l'AI, anche le organizzazioni dovrebbero farlo: sfruttare l'AI per migliorare il rilevamento delle minacce, automatizzare le risposte e prevedere potenziali violazioni della sicurezza. È essenziale implementare rigorose misure di sicurezza per proteggere i modelli e i dati AI.

Strategie di difesa per un futuro artificiale

La superficie di attacco continua a diventare più complessa; mentre si espande esponenzialmente, non è saggio presumere che tattiche e tecniche collaudate siano ormai superate. Le misure di sicurezza tradizionali saranno sempre più sfidate per gestire in modo completo tutti i rischi derivanti da minacce sia nuove che note.

Implementare un approccio alla cybersecurity basato sul rischio è essenziale, in particolare uno che consenta alle organizzazioni di identificare centralmente questi diversi asset e valutare e mitigare efficacemente i rischi. Semplificando e facendo convergere le operazioni di sicurezza, sarà più facile per le imprese mitigare i rischi e adottare una prospettiva proattiva sulla sicurezza.

Le imprese che integrano modelli linguistici di grandi dimensioni (LLM) dovrebbero dare priorità a robuste misure di sicurezza, tra cui il rafforzamento degli ambienti sandbox per l'esecuzione del codice, l'implementazione di una rigorosa convalida dei dati per prevenire l'esfiltrazione e l'avvelenamento dell'archivio vettoriale, e l'implementazione di difese multilivello contro l'iniezione di prompt.

In un mondo dove l'intelligenza artificiale rappresenta sia una minaccia che un'opportunità, le organizzazioni devono essere più vigili che mai, implementando strategie proattive che sfruttino la tecnologia per la protezione mantenendo al contempo un occhio attento sulle vulnerabilità umane che rimangono il primo punto di ingresso per i criminali informatici.

.jpg)