Hao Li è un innovatore nel campo a metà tra computer vision e computer graphic. Professore associato alla University of Southern California (USC), collaboratore di studio come Weta Digital e Industrial Light and Magic, ricercatore ed imprenditore, è una delle figure più influenti nel campo delle tecnologie per creare digital humans. Dalle sue ricerche nascono gli Animoji introdotti da Apple su Iphone X, ha lavorato, tra le altre cose, alla ricostruzione digitale di Paul Walker, prematuramente scomparso durante le riprese di Fast and Furious 7, e realizza avatar digitali realizzati con la sua azienda Pinscreen. Perchè allora Hao Li è anche una voce importante sui rischi derivanti da queste tecnologie, come i deepfakes?

Questa Domenica, 21 Marzo 2021, Hao Li terrà un keynote per la manifestazione VFXRio Live proprio sui temi dei digital human, dell’intelligenza artificiale e del futuro della tecnologia. L''evento che inizia alle 18,40 ora ialiane è disponibile grauitamente in streaming registrandosi a questo indirizzo. Abbiamo avuto la possibilità di intervistare in esclusiva Hao Li su questi argomenti.

Vedere per (non) credere

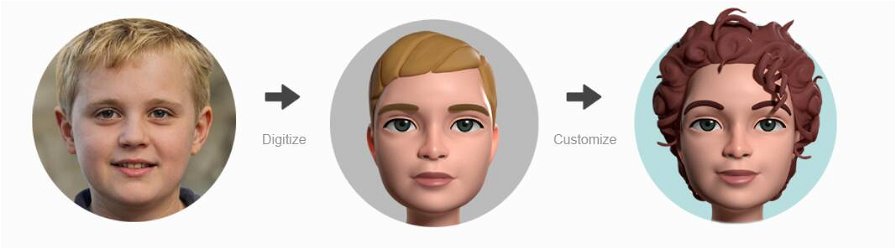

Molte delle pubblicazioni di Hao Li esplorano tecnologie che permettono di ricostruire volti 3d a partire da semplici fotografie tramite deep learning e reti neurali. Allo stesso tempo, molte delle sue apparizioni, come ad esempio il suo keynote al World Economic Forum di Davos, trattano proprio del problema dei deepfakes, cioè l’utilizzo di queste stesse tecnologie per creare filmati ed immagini che utilizzano le sembianze di persone ignare. Eppure, Hao Li non crede che ci sia contraddizione in questi due messaggi.

Dobbiamo essere responsabili di come queste tecnologie vengono utilizzate. Non dobbiamo smettere di utilizzarle, perché qualcun altro lo farà comunque. La cosa giusta da fare, secondo me, è prevenire che questa tecnologia sfugga al controllo. Ne abbiamo parlato con molti altri ricercatori che lavorano all'avanguardia di questo settore, e penso che educare il pubblico sia il primo passo per “vaccinarlo” e metterlo nelle condizioni di difendersi.

Hao Li descrive una situazione che non è tanto lontana dall'essere possibile: e se non stessi parlando con il vero Hao Li? Se qualcuno avesse hackerato l’e-mail di Hao Li e si fosse connesso alla videoconferenza Zoom usando la tecnologia deepfakes in real-time? Come potrei distinguerlo? Sapere che c’è questo rischio è un primo passo per alzare il mio livello di guardia, ma di certo non può bastare. Hao Li infatti continua:

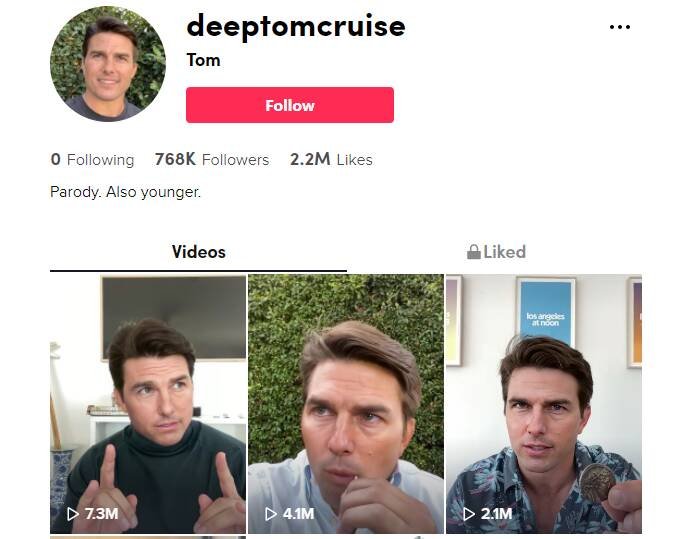

Certo, sapere che può succedere non è abbastanza. Innanzitutto, è già possibile creare un’illusione praticamente indistinguibile dalla realtà. Dico “praticamente” indistinguibile perché forse dovremo anche aspettare uno o due anni perché le tecnologie di rilevazione si adeguino, ma alla fine lo faranno. Ma ad occhio nudo sarà impossibile riconoscere un falso.Una cosa importante è il luogo in cui questo tipo di media viene consumato – come i social media, che sono il luogo dove le persone consultano le notizie. Ci sono posti come TikTok o Snapchat dove chiunque può condividere qualsiasi cosa, il contenuto non viene verificato ma si può diffondere molto velocemente. Credo tuttavia che ci stiamo già muovendo nella giusta direzione, con le persone che iniziano a segnalare non solo i deepfakes, ma fake news in generale e cose che sembrano sospette. Ma come serve la possibilità di segnalare qualcosa quando è già in circolazione, così c’è la necessità di una tecnologia che segnali automaticamente se un contenuto è sospetto e se c’è la possibilità che sia stato manipolato, senza intervento umano, così che qualcuno possa darci un’occhiata prima che inizi a diffondersi.

Più vero del vero

Persino gruppi importanti come il DARPA (dipartimento di ricerca avanzata del ministero della Difesa statunitensi) ha lanciato progetti come SemaFor (Semantic Forensic) – con cui Hao Li collabora – proprio per predire ed affrontare queste minacce di nuova generazione, tecnologie di manipolazione AI sempre più sofisticate o nuove forme di deepfakes, che non manipolano video ma che magari generano un fotogramma che non è reale ma che stimola una certa narrativa intorno ad esso, per manipolare l’opinione. Hao dice:

Credo che la tecnologia arriverà ad un punto in cui non si potrà più riconoscere un falso, dobbiamo allora considerare l’impegno necessario a creare un falso del genere. L’obiettivo è di renderlo più difficile possibile per evitare che questo tipo di cose inizino a diffondersi largamente. Un po’ come le e-mail spam: sono in giro da almeno 20 anni, e non si possono eliminare del tutto. Se ne possono filtrare un bel po’ però, e la gente è in qualche modo “vaccinata” per riconoscere quelle che non vengono filtrate.

La democratizzazione della CGI

Spesso, nel mondo dell'entertainment, lo sforzo per creare immagini fotorealistiche è immane. Quella che in gergo viene chiamata VFX pipeline è una catena di montaggio fatta di programmatori, artisti digitali, motion capture e tempi lunghissimi di elaborazione di ogni singolo fotogramma. Giorni di lavoro per ottenere una manciata di fotogrammi come nel caso di Fast and Furious 7. Allo stesso tempo, aziende come Pinscreen inventano nuovi algoritmi per ottenere risultati sempre migliori sostituendo al metodo di lavoro standard le reti neurali e il deep learning, anche in real-time grazie alla potenza di calcolo disponibile già oggi. Gli abbiamo chiesto quindi se il mondo della CGI tradizionale è a rischio.

Non in tempi brevi. La CGI è ancora molto importante per tutto ciò che deve essere renderizzato, per tutto ciò che è 3d. Ma di certo troverà un complemento nel deep learning, ed è quello che stiamo facendo. Realizziamo già ora dei sistemi ibridi, dove hai ancora il controllo creativo che hai con la CGI, quello di manipolare il contenuto del design con pieno controllo. Gli approcci basati sul deep learning hanno il vantaggio di risolvere problemi difficili, come ad esempio generare una scena che risulta immediatamente realistica, perché si basano su dati reali. Sul lungo periodo vedo di certo la possibilità che tutto venga sostituito dal neural rendering. Ci sono già algoritmi interessanti in questo senso: lo scorso anno è stato pubblicato un paper con un nuovo algoritmo chiamato Neural Radiance Fields (NeRF) che permette di saltare tutto il normale processo di rendering e costruire un oggetto 3d a partire da una serie di immagini. Naturalmente ci sono ancora molti limiti, come il tempo necessario a generare un’immagine – anche se abbiamo recentemente inviato un paper per dimostrare che si può fare anche in real-time, molto velocemente. E questo è solo l’inizio.

Il diritto d’autore della propria immagine

Ma se basta un’immagine (o una manciata di immagini) per poter generare un modello 3d di una persona o di una scena, può esistere una specie di copyright personale? Magari un NFT che stabilisca la proprietà della propria immagine. Hao Li sembra scettico:

“È difficile controllare una situazione del genere: come per tutti gli oggetti digitali, anche se ci possono essere metodi per distribuire o autenticare un’immagine, quando la puoi vedere, la puoi clonare. Una cosa che può avere senso è avere una regolamentazione a riguardo, anche se clonare qualcuno non è necessariamente dannoso. Certo può essere usato per creare qualcosa di spiacevole, ad esempio farti dire cose che non diresti mai; ma ci sono anche cose come il profilo TikTok deepTomCruise: è davvero un male? Non danneggia Tom Cruise, anzi forse lo rende ancora più popolare. Poi c’è la pratica di fare cose divertenti con i politici, e lì entriamo nel territorio della libertà di parola. Tutti possono scrivere quello che vogliono sugli altri, anche se spesso questa libertà viene usata per scrivere malvagità e danneggiare qualcuno, ma d’altro canto è un diritto. Alla fine, controlla è responsabilità della piattaforma dove questo tipo di cose circolano. Ma puoi veramente impedire a qualcuno di rubare l’identità di qualcun altro? Certo, è qualcosa di cui preoccuparsi, visto che è facile fa fare ed è facile usarlo poi per attività fraudolente. Ma tecnicamente è molto difficile da impedire: anche sistemi come il watermarking delle immagini o le e-mail criptate non vengono adottati di solito visto l’impegno aggiuntivo richiesto.

Commessi virtuali e modelli digitali

I digital avatar, di cui Pinscreen si occupa, non sono nuovi nell'immaginario fantascientifico e cyberpunk: dai cartelloni giganti e virtuali visti in Blade Runner o Blade Runner 2049, al bibliotecario virtuale interpretato da Orlando Jones nel film la Macchina del Tempo . Se però in molta fantascienza l’avatar digitale è spesso sinonimo di freddezza, di impersonalità, secondo Hao Li ci sono già molti esempi di interazioni positive con avatar digitali:

Ci sono luoghi dove queste interazioni non sono distopiche, per esempio i virtual influencers. Brud sta facendo qualcosa, con Lil Miquela – una modella, musicista e influencer instagram da 1 milione di follower, interamente generata in computer graphics – che piace molto alla gente, ed anche in Brasile c’è un virtual influencer molto popolare. Penso che stiano già diventando delle commodities e sono discretamente accettati dalla società. Hanno un vantaggio sulle persone reali, quello di essere in questo momento molto interessanti. Sono intenzionalmente un po’ meno realistici, perché specie nel mondo della moda se hai qualche peculiarità o sei diverso è qualcosa che puoi usare a tuo vantaggio. In un certo senso possono essere sì distopici, con dei look un po’ folli, ma in questo caso è una dichiarazione artistica. Stiamo lavorando con una importante azienda della moda giapponese, Zozo, per creare influencers virtuali. In questo esperimento che stiamo portando avanti abbiamo iniziato con immagini statiche, ma in un paio di settimane aggiungeremo video per dimostrare che si possono realizzare contenuti video in larga scala con influencer virtuali, utilizzando alcune delle tecniche di sintesi AI che abbiamo sviluppato per le facce, che infatti sono diverse da quelle che si trovano nella CGI tradizionale.

View this post on Instagram

La vera telepresenza

Il futuro del commercio, specie di quello online, passerà di certo per questi umani digitali, o virtual beings, come una naturale evoluzione dei chatbot odierni. Le stesse tecnologie che permettono di rendere più realistici questi digital humans hanno importanti risvolti anche per la comunicazione virtuale con tecnologie che permettono di digitalizzare la propria faccia e trasportarla nel mondo virtuale, come nel caso degli Animoji. Altrettanto importante, però, è trasferire l’interazione dal mondo virtuale al mondo reale, dalla visione degli altri umani digitali o commessi virtuali, ai dispositivi aptici per fornire sensazioni tattili. Hao Li ce lo spiega così:

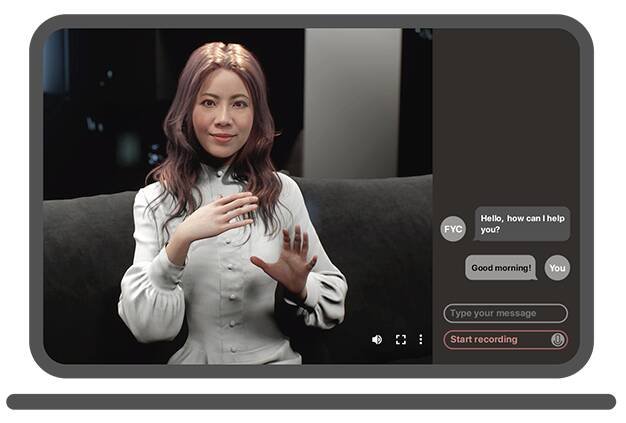

Molto del lavoro che stiamo facendo ora si concentra sullo skilled content creation e sull’interfaccia uomo-macchina, come parlare con un’assistente virtuale – e Hao Li ne ha dato esempio interagendo con una versione digitalizzata della moglie per il Virtual Being summit. Ma in futuro il focus passerà alla comunicazione, a portare le persone nella stessa stanza. Microsoft Hololens ha un bel concept video in cui mostra persone che si teletrasportano virtualmente in un altro ambiente. Questo è il futuro che arriverà, nel settore professionale già nei prossimi cinque anni e nel settore consumer a seguire, e i digital humans saranno ancora più necessari. E ovviamente non vogliamo focalizzarci solo sulla faccia, ma su tutto il linguaggio del corpo e anche sulle interazioni. Sicuramente ci servirà una combinazione di tecnologie hardware, dai sensori indossabili fino ai sistemi di eye tracking, che però non sono ancora ad un livello di sviluppo maturo: se pensiamo ai sistemi VR/AR, sono ancora molto ingombranti; gli ologrammi sono ancora ad uno stadio iniziale di ricerca. Ci sono tante soluzioni che potenzialmente arriveranno, e dovranno farlo perché noi viviamo in un mondo in tre dimensioni, e anche se ci muoviamo verso un mondo digitale, non possiamo ignorare l’aspetto tridimensionale.

Mai come in questo periodo di chiusure, lockdown, coprifuoco e smartworking questi argomenti sembrano attuali, come fa notare Matteo Moriconi, direttore del VFXRio Live e presidente della Brazilian Association of Visual Technology. Ed Hao Li ne sa qualcosa:

La pandemia ha sicuramente accelerato molti piani. Anche solo pensando a Pinscreen, prima le persone si chiedevano “perché dovrei avere un avatar, è interessante ma non indispensabile”, mentre ora chiedono direttamente “perché non lo abbiamo già?!” Pensate alla scuola o all'istruzione a distanza: siamo limitati ad uno schermo 2D, una chat e spesso non accendiamo neanche la camera, non c’è modo di fare le cose efficacemente. Tutti questi aspetti hanno spinto le persone ad esplorare i concetti di presenza virtuale, avatar digitale. PWC Londra ha già fatto partire un programma pilota dotandosi di set VR e permettendo agli impiegati in smartworking di partecipare a 2-3 meetings a settimana con aggiunta di VR, con ottimi risultati in termini di accettazione.

Hao conclude:

È una caratteristica fondamentale del genere umano, siamo animali sociali ed abbiamo bisogno di interagire giornalmente con altre persone.

E lo ringraziamo per quel che sta facendo per rendere le interazioni virtuali più umane.