Microsoft ha introdotto una nuova funzionalità di intelligenza artificiale agentica in Windows 11 per gli utenti del canale Insider, ma la stessa azienda di Redmond ha dovuto pubblicare un documento di supporto che ne evidenzia i rischi per la sicurezza. L'AI è ora in grado di eseguire operazioni autonome come l'organizzazione di file e l'invio di email, ma questo livello di accesso al sistema solleva preoccupazioni significative che hanno spinto l'azienda a implementare una soluzione di isolamento chiamata agent workspace. La funzionalità rappresenta un ulteriore passo nell'integrazione dell'intelligenza artificiale nel sistema operativo, ma conferma anche quanto sia complesso bilanciare innovazione e protezione dei dati degli utenti.

L'agent workspace funziona essenzialmente come un profilo utente limitato dedicato esclusivamente all'AI agentica. Questo ambiente ristretto consente all'intelligenza artificiale di accedere ad applicazioni e file comuni del sistema, ma le impedisce di utilizzare software installati per utenti specifici e di accedere ai dati protetti nella directory del profilo utente (C:\Users\) senza autorizzazione esplicita. Microsoft sostiene che questa architettura sia più efficiente di una macchina virtuale completa come Windows Sandbox, pur mantenendo l'isolamento di sicurezza, il supporto per l'esecuzione parallela e il controllo da parte dell'utente.

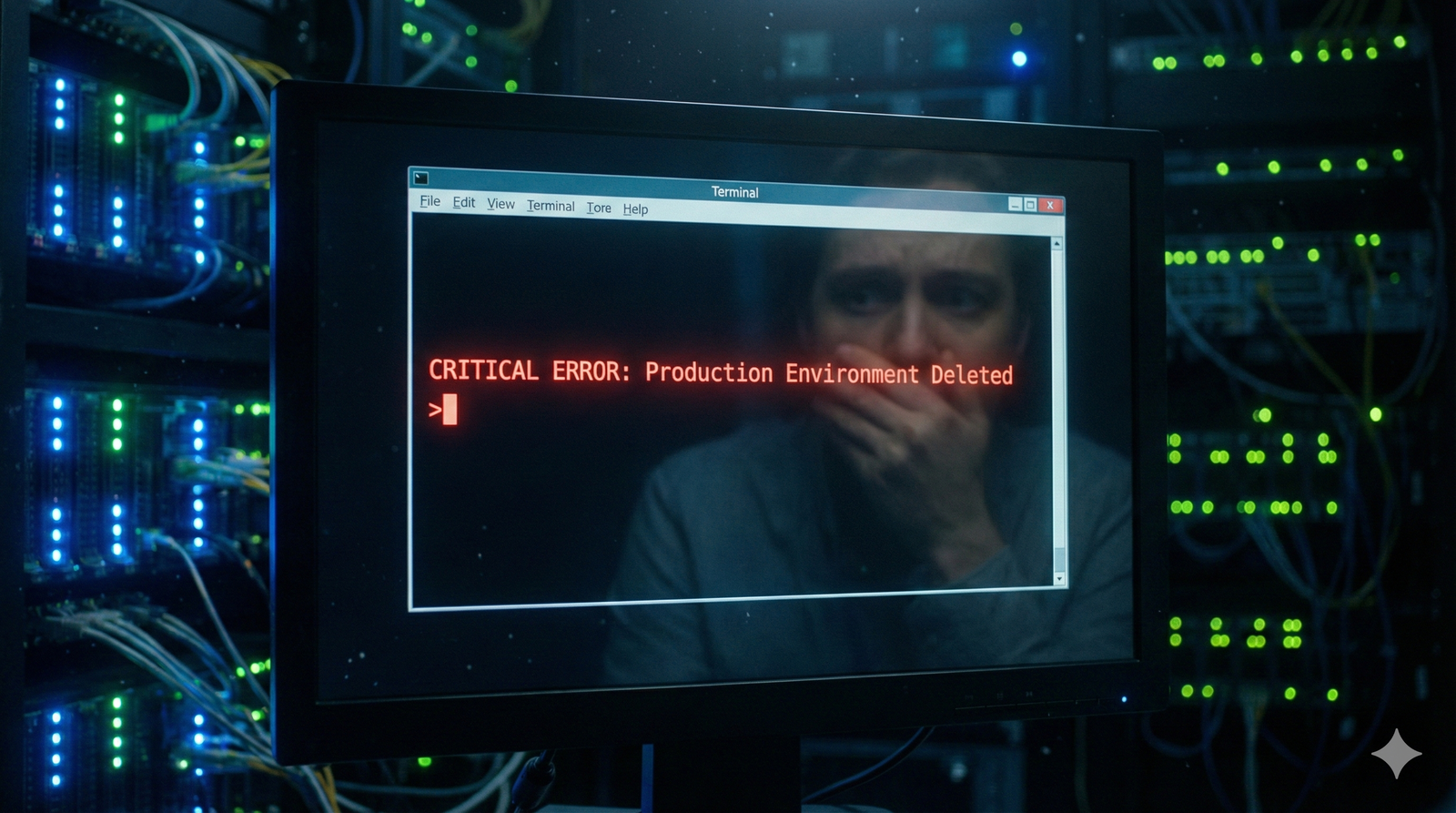

Le misure di sicurezza implementate includono la registrazione dettagliata di tutte le azioni eseguite dall'AI, privilegi limitati per gli agenti e l'accesso esclusivo da parte del creatore originale. Tuttavia, l'azienda riconosce esplicitamente i rischi intrinseci di questa tecnologia. Nel documento di supporto, Microsoft avverte che "le applicazioni di AI agente introducono rischi di sicurezza inediti, come il cross-prompt injection (XPIA), in cui contenuti dannosi incorporati in elementi dell'interfaccia o documenti possono sovrascrivere le istruzioni dell'agente, portando ad azioni indesiderate come l'installazione di malware".

La funzionalità rimane disattivata per impostazione predefinita e richiede un'attivazione manuale attraverso il percorso Sistema > Componenti AI > Funzionalità agente sperimentali. Microsoft raccomanda esplicitamente agli utenti di comprendere appieno le implicazioni per la sicurezza prima di abilitarla, sottolineando che l'attivazione vale per tutti gli utenti del sistema. Questa cautela riflette la consapevolezza dell'azienda riguardo ai potenziali vettori di attacco che un'AI con accesso privilegiato al sistema potrebbe rappresentare.

L'iniziativa si inserisce nella strategia aggressiva di Microsoft per l'adozione dell'intelligenza artificiale, culminata nel lancio dei Copilot+ PC. Tuttavia, l'accoglienza del mercato non ha finora corrisposto alle aspettative: i dati indicano che molti acquirenti scelgono questi dispositivi principalmente perché rappresentano l'offerta disponibile, non per le loro capacità AI. Alcuni utenti frustrati dall'integrazione forzata di funzionalità AI in Windows hanno persino migrato verso macOS, mentre le funzioni esclusive dei dispositivi AI, come Microsoft Recall, si sono rivelate incubi per la sicurezza nonostante il loro potenziale.