Gli algoritmi di machine learning possono capire che tipo di emozione stiamo provando, ed entro certi limiti sono anche in grado di comprendere se qualcuno sta mentendo. Si tratta di una disciplina direttamente legata al riconoscimento dei volti, in sviluppo da ormai oltre 15 anni.

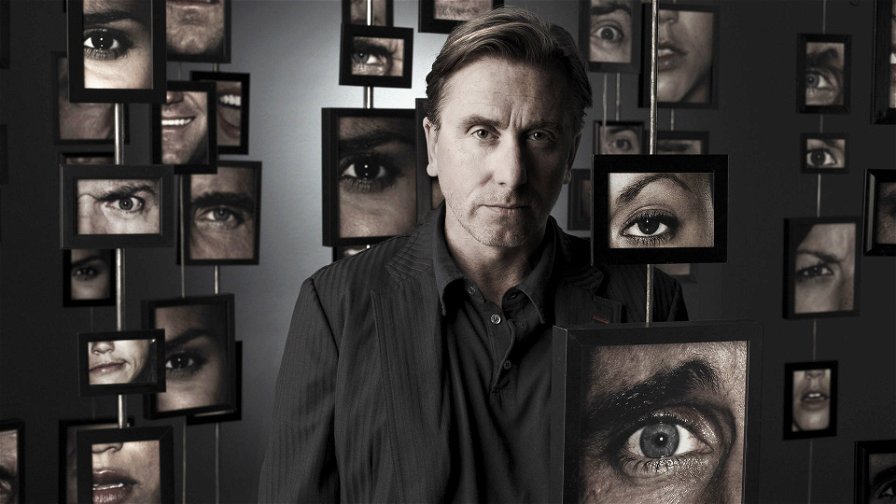

Ad avviare le danze fu la TSA, l'agenzia degli Stati Uniti che si occupa della sicurezza aerea: era il 2007 e i problemi superavano abbondantemente i benefici - soprattutto a causa dei falsi positivi, e in buona parte anche per i noti problemi di discriminazione. Il sistema si chiamava Spot ed era basato sulla lettura delle microespressioni descritta da Paul Ekman. Un metodo descritto in libri come Te lo leggo in faccia. Riconoscere le emozioni anche quando sono nascoste, dello stesso Ekman, e rappresentato nella riuscita (almeno la prima stagione) serie TV Lie to me.

Nel tempo gli studi sono proseguiti e, per quanto lo stesso Ekman abbia i suoi dubbi, molti sono convinti che emozioni e menzogne ci si possano "leggere in faccia". La faccenda ha fatto nascere un business da 20 miliardi di dollari, come riporta Oscar Schwartz sul Guardian. Ci sono anche aziende specializzate, come la statunitense Afectiva, citata nello stesso articolo; cercando di applicare il riconoscimento emozionale a diversi contesti, dalla guida autonoma al marketing, dalla cura della persona alla sicurezza informatica. Oggi anche colossi come IBM, Microsoft o Amazon usano questo tipo di tecnologia, integrata nel riconoscimento facciale.

Il metodo applicato è quello dell'apprendimento supervisionato. Prima gli algoritmi vengono addestrati con uno specifico dataset: nella fattispecie, una serie di microespressioni abbinate a un certo stato emotivo. Successivamente, il sistema cerca di ritrovare gli stessi segnali in dati nuovi. Ne abbiamo parlato nella recensione del libro Artificial Intelligence di Alessandro Vitale.

Come negli altri casi di apprendimento supervisionato, la qualità e la quantità di dati è determinante. Addestrare gli algoritmi con informazioni non adeguate, infatti, può generare risultati indesiderati, inaffidabili o completamente sbagliati. Affectiva sostiene di poter contare su oltre 7,5 milioni di volti da tutto il mondo, e che il suo sia "l'archivio di emozioni più grande al mondo". Le persone ritratte si sono volontariamente registrate guardando la TV o nelle loro attività quotidiane, fornendo poi il video all'azienda.

Il personale dell'azienda poi guarda i video e li annota, associando a ogni momento uno stato emotivo; un passaggio cruciale, perché poi i dati saranno usati per addestrare l'algoritmo. Gli operatori applicano il metodo sviluppato da Ekman e altri negli anni '80, e per etichettare un'immagine o un video devono scegliere all'interno di una tabella.

Dubbi e pericoli

Paul Ekman ha brevettato il suo metodo e lo ha venduto in tutto il mondo, sopratutto ad agenzie di intelligence e di sicurezza. Non tutti però sono convinti che funzioni. Per esempio, Lisa Feldman Barrett (Northeastern University) ha sviluppato un metodo alternativo che porta a risultati anche molto diversi da quelli ottenuti con il metodo Ekman.

Il punto fondamentale, secondo Barret, è che non esistono "emozioni universali", né tantomeno segnali universalmente interpretabili nelle nostre espressioni. Ma se questo è vero, allora, l'industria da 20 miliardi di dollari è fondata sul nulla.

Il che non sarebbe grave se si trattasse di semplice impresa privata, poiché ognuno è libero di fallire come gli pare. Ci sono stati casi in cui le macchine si sono rivelate anche meglio degli umani nel riconoscere le emozioni, ma è lecito dubitare che sia ancora troppo presto per usare questi sistemi in ambiti ufficiali e delicati.

E invece è proprio ciò che sta accadendo. "Ci sono già società di reclutamento che usano queste tecniche per capire se un candidato è valido oppure no", spiega Meredith Whittaker (Istituto AI Now, Università di New York). "Si vedono anche esperimenti in contesti scolastici, per capire se un alunno si annoia o è coinvolto o arrabbiato. Queste informazioni si potrebbero usare per impedire a qualcuno di ottenere un lavoro o per definire il modo in cui vengono trattate a scuola. E se l'analisi non è estremamente precisa, è un rischio materiale concreto".

Rana el Kaliouby, fondatrice e CEO di Affectiva, si dice consapevole dei rischi, e di quanto sia importante un dibattito pubblico sul tema. E per questo, spiega, hanno sviluppato strumenti di analisi che tengono in considerazione la diversità culturale ed etnica. Di contro, però, Whittaker è preoccupata dalla possibilità di un inquietante ritorno del passato lombrosiano, ma "benedetto" dall'automazione. Il reporter del Guardian parla di "fisiognomica automatica". Il termine, vale la pena ricordarlo, indica una pseudoscienza, e di conseguenza tutti i rischi e i pericoli che implica.