Fino ad oggi, quando si parlava di intelligenza artificiale le aziende hanno sempre guardato alle prestazioni dei modelli, seguendo una semplice regola: un modello di grandi dimensioni, addestrato con un'elevata quantità di calcoli, avrà prestazioni migliori. Questa legge di scala dell'IA, teorizzata da OpenAI e spiegata in un paper del 2020 intitolato "Scaling Laws for Neural Language Models", supportato da un articolo successivo di Google DeepMind ("Training Compute-Optimal Large Language Models"), si sta però scontrando con una realtà forse inaspettata: gli avanzamenti degli LLM sono sempre più lenti.

Il cambiamento delle leggi di scala

Le leggi di scala dell'AI stanno subendo un cambiamento. Le performance dei modelli stanno progredendo, ma non solo grazie all'aumento dei dati e della potenza di calcolo. Ecco perché OpenAI ha introdotto i suoi modelli di ragionamento AI o1 e o3 dopo la serie GPT, come sottolineato da Garry Tan, presidente dell’accelleratore di startup Y Combinator, nel video series YC Decoded. OpenAI ha utilizzato le tecniche di "catena di pensiero" per ottimizzare le risposte del modello, ottenendo così prestazioni migliorate. Questo è visibile nel recente rilascio del modello o3, che ha raggiunto traguardi considerati precedentemente irraggiungibili per l'IA. “OpenAI ha scoperto che più tempo il modello o1 poteva "riflettere", meglio si comportava”, ha detto Tan.

La sfida della scalabilità

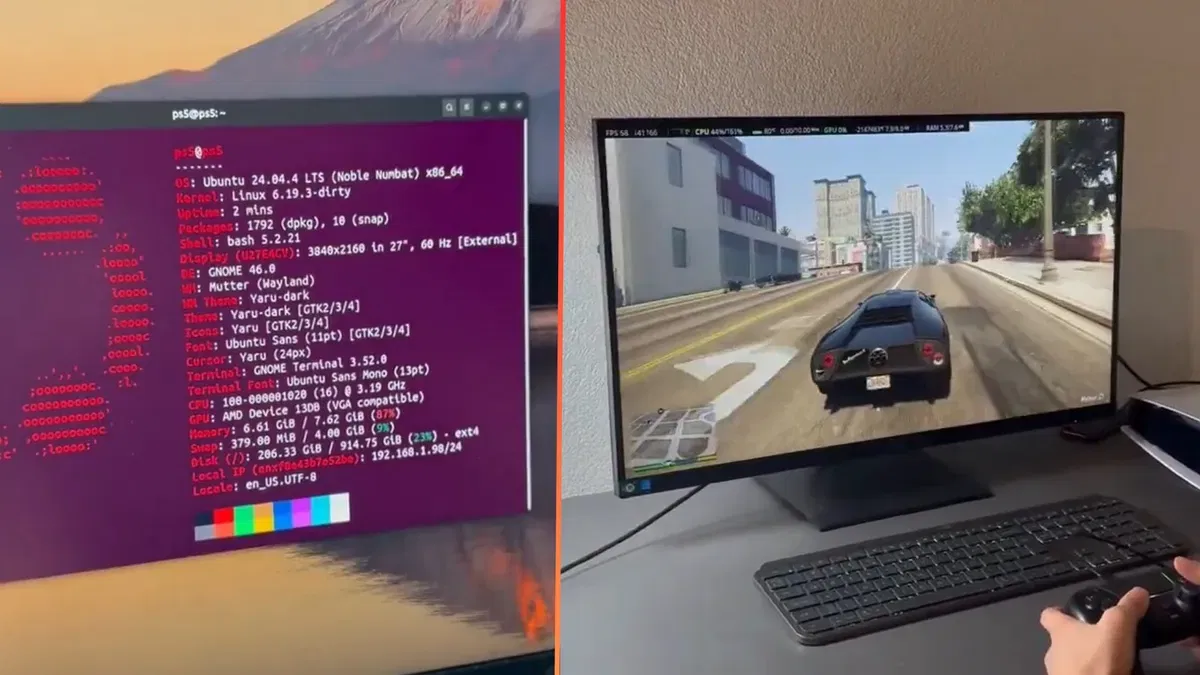

Adnan Masood, capo architetto di AI presso UST, ha segnalato che i due principali "carburanti" per la scalabilità - dati e calcolo - stanno diventando più rari e costosi. Questo indica un possibile plateau per i large language models. Per esempio, nei quiz di conoscenza, nei problemi matematici e nei test di programmazione, i progressi stanno "appiattendosi". Nel benchmark MMLU, GPT-3 ha registrato il 43.9% passando però al 86.4% con GPT-4 nel 2023, per poi raggiungere un plateau del 90% nel 2024.

Il futuro dell'IA

Tan e Masood concordano che se le vecchie leggi di scala stanno perdendo terreno, i modelli di AI dovranno ricorrere a nuove tecniche. In particolare, il futuro dell'IA sembra spostarsi verso architetture più intelligenti, modelli guidati dal ragionamento e utilizzo di fonti di dati distribuite. Negli Stati Uniti, i principali modelli di AI rimangono "top" per circa tre settimane prima di essere superati, in particolare dai competitor open source, secondo un report di Innovation Endeavors del giugno 2025. La velocità di rilascio dei modelli rimane elevata anche se non più esponenziale.