Intel ha annunciato importanti progressi nella realizzazione di reti neurali ottiche. Usando la luce al posto degli elettroni, questi chip potrebbero essere fino a 100 volte più efficienti e ridurre la latenza in molti ordini di grandezza. Intel ha simulato due architetture ONN (optical neural network) al fine di considerarne scalabilità e producibilità, così come scritto in un recente articolo accessibile a questo indirizzo. L'uso di fotoni (la luce) al posto degli elettroni come mezzo per l’elaborazione e il medesimo silicio impiegato per i chip convenzionali è noto con il termine "fotonica del silicio" (silicon photonics).

Finora però l'uso commerciale di questa tecnologia è stato limitato al solo movimento dei dati. Sono stati proposti diversi progetti per le reti neurali ottiche (ONN), ma nel 2017 fu dimostrato che un componente comune dei circuiti fotonici (chiamato MZI) poteva essere configurato per eseguire alcune forme di moltiplicazione di una matrice 2x2.

Fu inoltre illustrato che era possibile creare un maggior numero di matrici collocando l’MZI in una griglia triangolare. Emerse che i circuiti fotonici erano capaci di svolgere moltiplicazioni matrice-vettore. Due anni fa alcuni ricercatori del MIT proposero una ONN basata sugli MZI, e chiaramente Intel si dimostrò subito interessata al progetto.

La ricerca e il contributo di Intel si concentrarono nel capire cosa succedesse introducendo degli errori di fabbricazione, ai quali l’ONN è suscettibile (dal momento che l’elaborazione fotonica è di natura analogica) e che causano variazioni all'interno e tra i chip.

Anche se studi in merito erano già stato fatti, il lavoro precedente si concentrava sulle ottimizzazioni post-fabbricazione al fine di affrontare tali imprecisioni. La scarsa scalabilità all'aumentare della grandezza delle reti portava però a una richiesta di potenza di calcolo sempre maggiore per configurare le reti ottiche.

Invece dell’ottimizzazione post-fabbricazione, Intel ha quindi considerato un training (allenamento) pre-fabbricazione. Intel ha istruito una sola volta una ONN ideale, in seguito alla distribuzione dei parametri di allenamento su più istanze ad hoc della rete con componenti imprecisi.

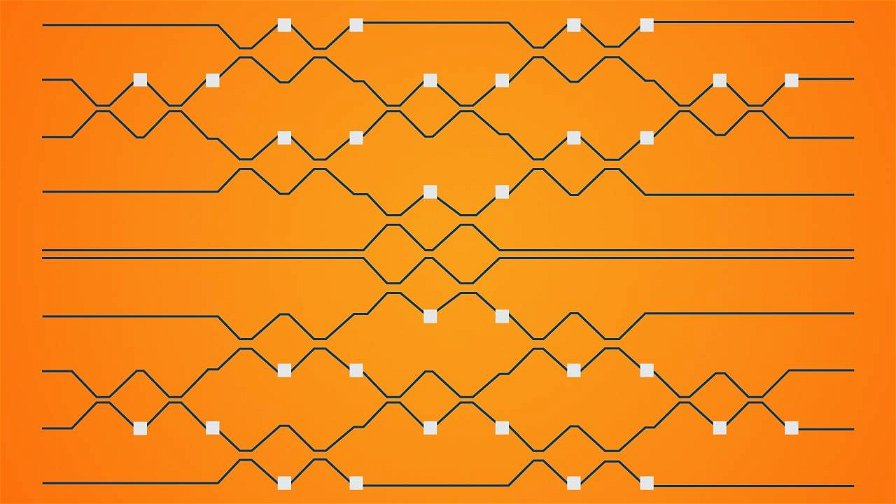

Intel ha preso in considerazione due differenti architetture di ONN, in base al modo in cui erano stati collocati gli MZI. L'azienda ha sviluppato un design maggiormente personalizzabile, chiamato GridNet, ed un’architettura chiamata FFTNet più tollerante agli errori, e simulato gli effetti delle imperfezioni (l'ONN eseguiva solo le operazioni basate su matrici).

Quando non c’erano più errori, GridNet mostrava un margine di accuratezza maggiore (98%) rispetto a FFTNet (95%) nel benchmark MNIST. Tuttavia introducendo del rumore nei componenti fotonici, FFTNet si rivelava significativamente più resistente: mentre l’accuratezza di FFTNet rimaneva più o meno costante, i ricercatori notavano che quella di GridNet calava sotto il 50%.

Laddove le ricerche di Intel erano basate su simulazioni, una startup del MIT ha dimostrato di recente un prototipo di circuito fotonico integrato che riduce la latenza di 10.000 volte e migliora l’efficienza energetica di “ordini di grandezza”, mostrando che questi design hanno le potenzialità per diventare una valida alternativa alle odierne reti neurali digitali elettroniche.

Il general manager dell’Intel AI Products Group, Naveen Rao, ha sottolineato in un tweet che "ci sono ancora problemi difficili da risolvere, ma (i processori basati su reti neurali ottiche) potrebbero cambiare il substrato fondamentale dell’informatica”.

In ogni caso non è l’unica opzione su cui Intel sta lavorando nel campo dell’IA: Intel sta svolgendo ricerche anche sui chip neuromorfici e sul calcolo probabilistico.