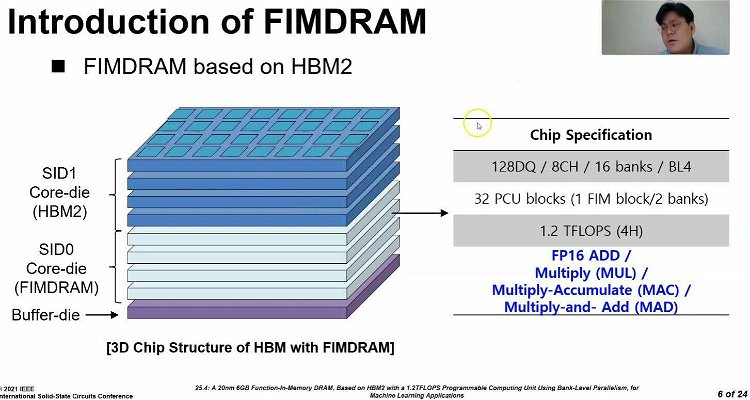

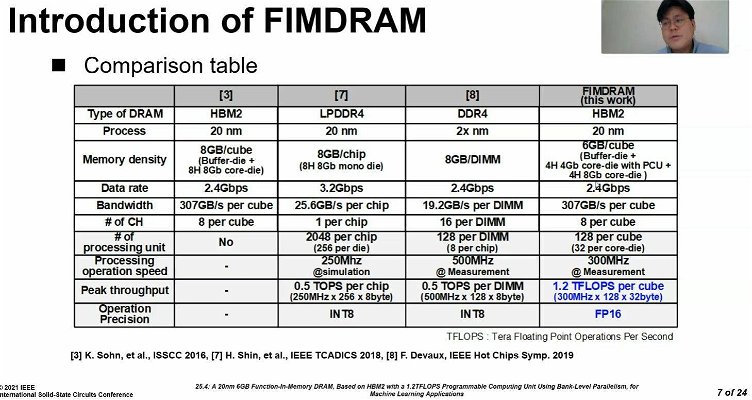

Samsung ha recentemente presentato le sue nuove memorie HBM2 dotate di un processore AI integrato in grado di eseguire calcoli fino a 1,2TFLOPS, consentendo al chip di memoria stesso di effettuare operazioni che prima erano solitamente riservate a CPU, GPU, ASIC, o FPGA. I nuovi chip HBM-PIM (processing-in-memory) sono dotati di un engine AI all'interno di ciascun banco di memoria e sono progettati per alleviare il carico dovuto allo spostamento di dati tra memoria e processore, che si dimostra spesso più costoso in termini di consumo energetico e tempo rispetto alle effettive operazioni di elaborazione.

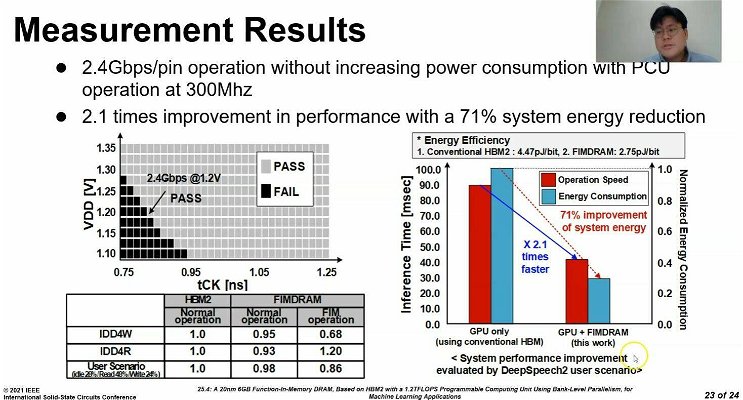

Samsung afferma che, se applicata alle esistenti memorie HBM2 Aquabolt, la tecnologia può fornire il doppio delle prestazioni riducendo il consumo di energia di oltre il 70%. L'azienda afferma inoltre che la nuova memoria non richiede alcuna modifica software o hardware (inclusi i controller), consentendo così un time-to-market più rapido. La compagnia ha dichiarato che la memoria è già in fase di sperimentazione negli acceleratori AI presso i principali fornitori e prevede che tutte le convalide saranno completate nella prima metà di quest'anno, decretandone una rapida commercializzazione. Samsung ha presentato ulteriori dettagli sulla sua nuova architettura di memoria durante l'International Solid-State Circuits Virtual Conference (ISSCC) di questa settimana.

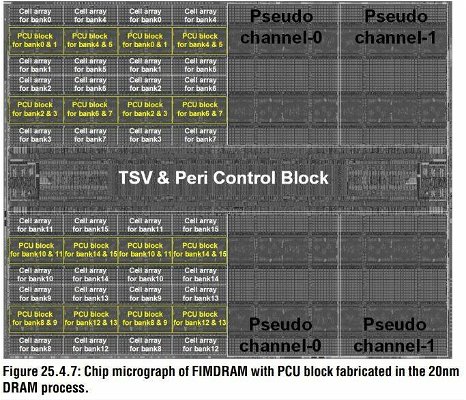

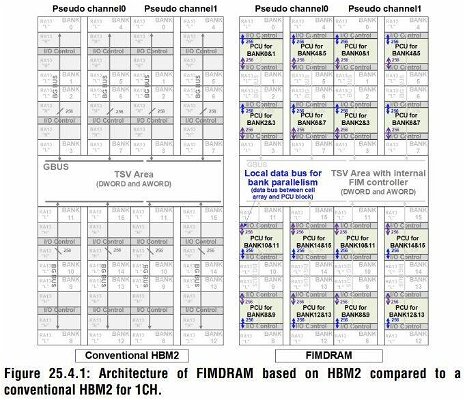

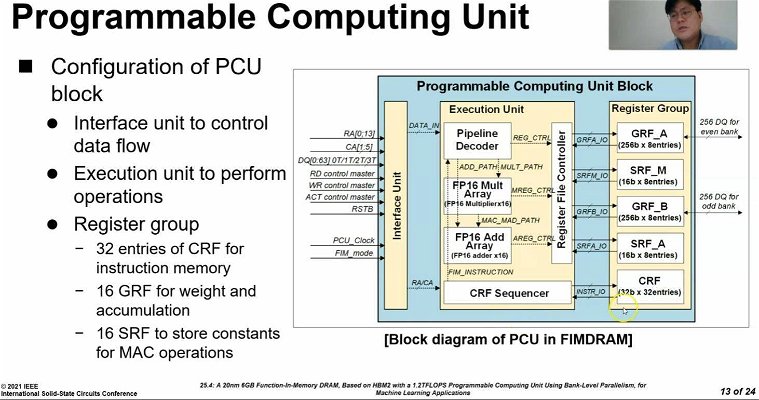

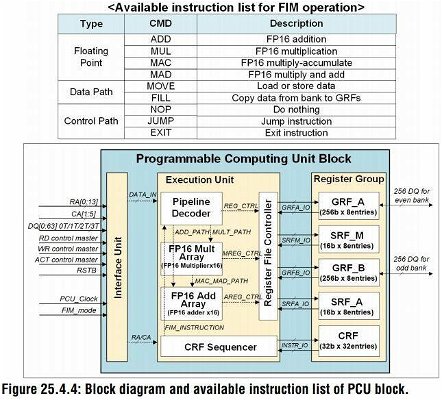

Come potete vedere dalle slide qui sopra, ogni banco di memoria ha un'unità di elaborazione programmabile (PCU) incorporata che funziona a 300MHz. Questa unità è controllata tramite i comandi di memoria convenzionali dall'host per abilitare l'elaborazione in-DRAM e può eseguire vari calcoli FP16. La memoria può anche funzionare in modalità standard, il che significa che opererà come una normale HBM2. Naturalmente, fare spazio per le unità PCU ha ridotto la capacità complessiva: ogni die dotato di PCU ha la metà della capacità (4GB) per die rispetto a un die HBM2 standard da 8GB. Per aiutare a risolvere questo problema, Samsung utilizza stack da 6GB combinando quattro die da 4GB con PCU con quattro die da 8GB senza PCU (al contrario di uno stack da 8GB di normale HBM2).

Sfortunatamente, non vedremo questa tecnologia nelle schede grafiche, almeno per ora. Samsung ha affermato che la nuova memoria è destinata a soddisfare i requisiti di elaborazione su larga scala nei data center, sistemi HPC e applicazioni mobili abilitate all'intelligenza artificiale. Kwangil Park, vicepresidente senior della divisione Memory Product Planning di Samsung Electronics, ha dichiarato:

La nostra rivoluzionaria HBM-PIM è la prima soluzione PIM programmabile del settore su misura per diversi carichi di lavoro basati sull'intelligenza artificiale come HPC, formazione e inferenza. Abbiamo in programma di sfruttare questa tecnologia collaborando ulteriormente con i fornitori di soluzioni AI per realizzare applicazioni PIM ancora più avanzate.

ASRock B450M Steel Legend è una scheda madre con socket AM4 pronta ad ospitare i nuovi processori di AMD, la trovate su Amazon a meno di 100 euro!

.png)