Il panorama dello sviluppo software è testimone di una nuova, potenziale rivoluzione. Durante l'attesissimo evento Google I/O 2025, il colosso tecnologico ha annunciato una serie di innovazioni nel campo dell'intelligenza artificiale, tra cui spicca il lancio in beta pubblica di Jules, il suo agente di codifica IA, e la presentazione di Stitch, un nuovo strumento sperimentale per la generazione di interfacce utente (UI) basato su IA. Queste novità promettono di trasformare radicalmente il modo in cui sviluppatori e designer concepiscono e realizzano applicazioni.

Jules: il compagno di codifica diventa accessibile a tutti

Presentato per la prima volta nel dicembre del 2024, Jules aveva già suscitato un enorme interesse nella comunità degli sviluppatori. Ora, a pochi mesi di distanza, Google ne ha annunciato la disponibilità in beta pubblica, estendendo l'accesso a un pubblico più vasto. La particolarità di Jules risiede non solo nella sua capacità di semplificare il processo di programmazione, ma soprattutto nel suo funzionamento asincrono: l'IA può lavorare in background su compiti complessi mentre lo sviluppatore continua le proprie attività, ottimizzando tempi e risorse.

Integrandosi direttamente nei progetti e repository esistenti, Jules opera clonando la codebase su una macchina virtuale (VM) sicura di Google Cloud. Da qui, può collaborare attivamente con gli sviluppatori per eseguire una vasta gamma di azioni: dalla creazione di nuove funzionalità alla generazione di changelog audio, dall'aggiornamento delle versioni delle dipendenze alla scrittura di test unitari e alla correzione di bug. Google ha posto grande enfasi sulla privacy, assicurando che Jules operi in modalità privata di default quando lavora su repository privati e che il codice proprietario non venga utilizzato per l'addestramento del modello.

L'accesso a Jules avviene direttamente tramite l'app Gemini, eliminando la necessità di familiarizzare con nuovi strumenti e interfacce. Questa mossa rientra nella strategia di Google di rendere Gemini un assistente di codifica sempre più completo e appetibile. Le prime reazioni della comunità online sono state entusiastiche, con molti che già definiscono Jules un potenziale "Codex killer", in riferimento all'agente di codifica di OpenAI. Tuttavia, come per ogni tecnologia IA, sia Jules che Codex sono in continua evoluzione, con aggiornamenti costanti che ne arricchiscono le funzionalità.

Durante il periodo di beta pubblica, Jules sarà disponibile per tutti gli utenti con accesso a Gemini, nelle regioni in cui il servizio è attivo. Sebbene non siano stati ancora comunicati dettagli sui prezzi futuri, Google ha specificato che verranno definiti con la maturazione della piattaforma. Per ora, gli sviluppatori possono sperimentare Jules, tenendo conto di alcuni limiti di utilizzo previsti per la fase di beta. Parallelamente, Google ha svelato di essere al lavoro su una nuova IA destinata ad aiutare Gemini a sviluppare versioni ancora più performanti di sé stesso, in un ciclo di auto-miglioramento continuo.

Stitch: l'IA che disegna e codifica UI complesse

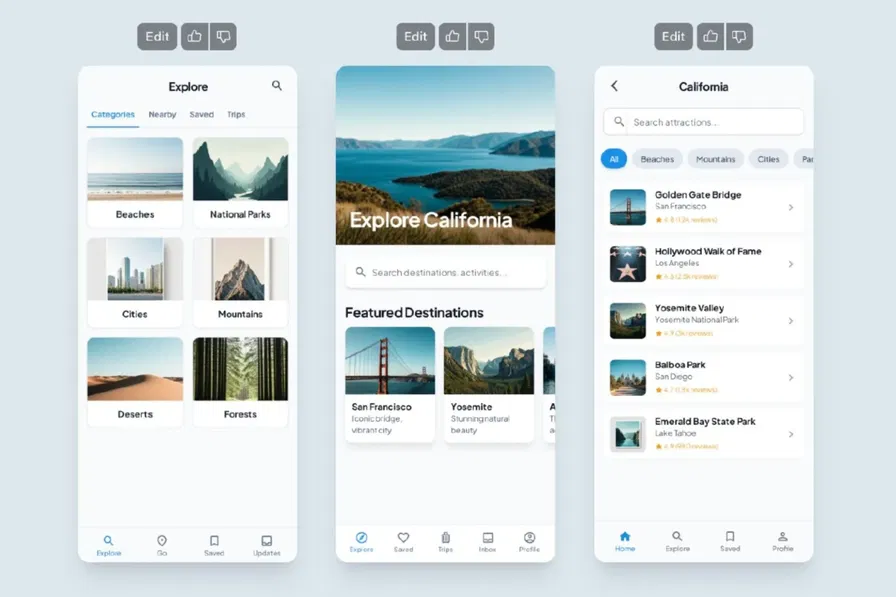

Accanto a Jules, Google I/O 2025 ha visto il debutto di Stitch, un innovativo strumento di IA generativa progettato per aiutare gli sviluppatori a trasformare rapidamente idee grezze di interfacce utente in design funzionali e pronti per l'applicazione. Basato sulla potenza di Gemini 2.5 Pro, Stitch è attualmente disponibile come esperimento su Google Labs.

Secondo quanto annunciato, Stitch è in grado di convertire prompt testuali (attualmente supportati in lingua inglese) e immagini di riferimento – come wireframe, schizzi approssimativi o screenshot di altre UI – in "design di UI complessi e codice frontend in pochi minuti". Questo processo risparmia agli sviluppatori la laboriosa creazione manuale degli elementi di design e la successiva programmazione. È possibile fornire dettagli specifici, come palette di colori desiderate o indicazioni sull'esperienza utente, per guidare la generazione.

Stitch offre la possibilità di generare "molteplici varianti" di un'interfaccia, facilitando la sperimentazione con stili e layout differenti. Gli asset della UI vengono prodotti insieme a codice frontend completamente funzionante, che può essere integrato direttamente nelle app o esportato su Figma. Quest'ultima opzione è strategica, considerando la popolarità di Figma come piattaforma per il design di prodotto, ideale per rifinire gli elementi visivi, integrare i design con sistemi esistenti e facilitare la collaborazione tra sviluppatori e designer.

L'aspetto della codifica automatica di Stitch entra in diretta competizione con l'app "Make UI" di Figma, annunciata all'inizio di questo mese. La mossa di Google potrebbe essere interpretata come un tentativo di offrire una soluzione integrata che impedisca ai designer, già utenti dello strumento Code Assist di Gemini, di migrare completamente verso altre piattaforme.

Il futuro della programmazione è a fianco dell'IA

Il lancio in beta di Jules e la presentazione di Stitch rappresentano un passo significativo nella visione di Google per un futuro in cui l'IA è un partner collaborativo a tutti gli effetti nello sviluppo software. Questi strumenti non solo promettono di accelerare i cicli di sviluppo e di aumentare la produttività, ma potrebbero anche democratizzare l'accesso alla creazione di software e interfacce utente, abbassando la soglia di ingresso per chi ha idee innovative ma minori competenze tecniche specifiche.

Con Jules che si occupa della logica di programmazione e Stitch che facilita la prototipazione e la realizzazione del frontend, il messaggio di Google sembra chiaro: le scuse per non trasformare un'idea in un prodotto funzionante sono sempre meno. Resta da vedere come questi strumenti si evolveranno, quale sarà il loro impatto a lungo termine sul mercato del lavoro per sviluppatori e designer, e come si posizioneranno nel crescente panorama degli assistenti di codifica e design basati sull'intelligenza artificiale. Una cosa è certa: l'era dell'IA come copilota nello sviluppo è ormai iniziata.