Anche l'intelligenza artificiale, alla pari del proprio creatore – l'uomo -, può sbagliare; ma chi sarà il responsabile dell'errore? E, ancor peggio, qualora dovesse esserci un danno, chi lo risarcirà?

La necessità di fornire una risposta a questi interrogativi è stata percepita anche dalla Commissione Europea che nella Risoluzione del 16 febbraio 2017, in cui ha avanzato la proposta di un codice etico-deontologico nel settore dell'intelligenza artificiale, ha precisato che la responsabilità civile per danno causato da algoritmo non deve subire né una limitazione del tipo e dell'entità del danno risarcibile, né delle "forme di risarcimento che possono essere offerte alla parte lesa per il semplice fatto che il danno sia provocato da un soggetto non umano".

La responsabilità del produttore: direttiva 85/374/CE e profili di incompatibilità

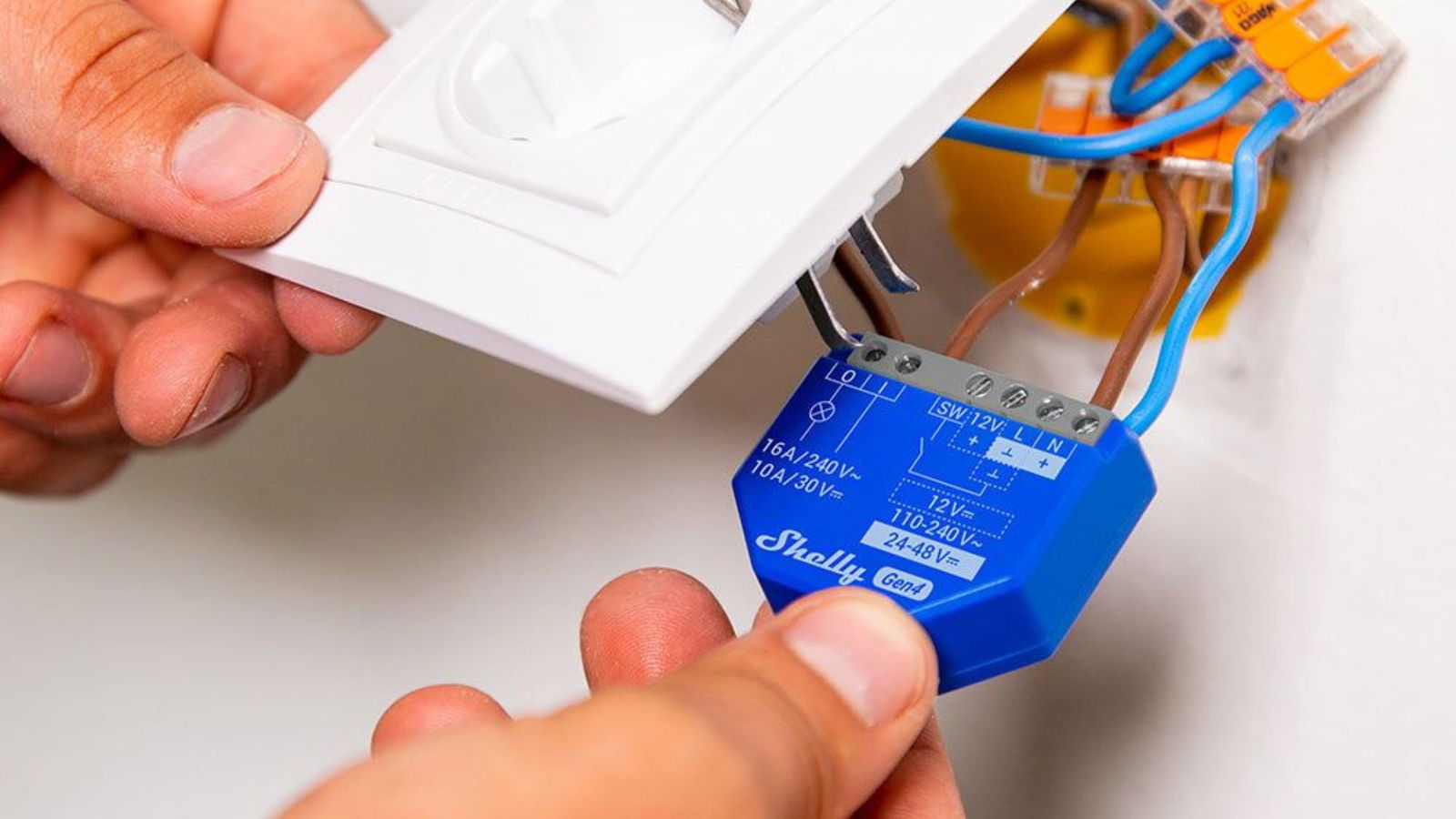

Una prima soluzione può essere fornita dalla normativa attuale. La direttiva 85/374/CE, poi modificata dalla 99/34/CEE, riesce a far fronte a tutte le situazioni di danni causati da prodotti difettosi. Per "prodotto" all'art. 2 si intende "ogni bene mobile anche se fa parte di un altro bene mobile o immobile", e quindi la prima caratteristica deve essere la tangibilità. Il prodotto sarà difettoso quando non "offrirà la sicurezza che ci si può legittimamente attendere, tenuto conto della presentazione, dell'uso al quale è destinato e del momento della messa in circolazione". Il responsabile del danno causato dal prodotto difettoso sarà il "produttore", inteso come il "fabbricante di una materia prima, del prodotto finito o di una parte di esso". Si tratta di una responsabilità "oggettiva" o "senza colpa" del produttore, in quanto si discosta dalla necessità di prova del dolo o della colpa tipica della responsabilità extracontrattuale (art. 2043 c.c.).

L'onere della prova spetta al danneggiato che deve dimostrare il difetto del prodotto, l'esistenza del danno ed il nesso di causalità tra il difetto ed il danno. Tuttavia, il produttore può sempre provare di non essere il responsabile del danno, dimostrando ad esempio che il difetto che ha causato il danno non esisteva al momento della circolazione o che sia sorto successivamente, oppure che le conoscenze tecniche scientifiche del momento di creazione del dispositivo non permettevano di prevedere il difetto e di conseguenza di neutralizzarlo.

Quanto stabilito a livello europeo è confluito nell'ordinamento giuridico italiano con il d.p.r. 224/1988 e poi nel codice del consumo (D.lgs. 206/2005).

Un problema di compatibilità tra la normativa in questione e l'A.I. sorge, innanzitutto, in riferimento alla tangibilità. I dispositivi dotati di intelligenza artificiale dal punto di vista della tangibilità sono definiti come ibridi, in quanto presentano, da un lato, una componente materiale, e dall'altro, una componente immateriale, quale il software. Il danno causato dalla componente materiale difettosa rientrerebbe nella normativa in questione. Ciò non si può dire per il danno causato da software, che, invece, rientrerebbe nella proprietà industriale. La mancanza di un fondamento legislativo, in tal caso, non può escludere una responsabilità della catena di produzione. Ulteriori criticità emergerebbero anche in sede di qualificazione dei soggetti coinvolti nella produzione dei dispositivi dotati di A.I.. Tra i partecipanti vi sono il programmatore ed il produttore. Il programmatore è colui che crea gli algoritmi o i programmi attraverso cui i dispositivi agiscono, il produttore sviluppa in concreto la macchina per la produzione e la diffusione di massa. Queste due figure possono non coincidere e qualora ciò accadesse il produttore potrà sempre rivalersi sul programmatore. La definizione generica di "produttore" contenuta nella direttiva sarebbe parzialmente compatibile con quella di catena di produzione, tanto da rendere difficile individuare un unico soggetto responsabile. Soluzione intermedia sarebbe quella di attribuire la responsabilità ad entrambi, così come accade in presenza di un fornitore.

La responsabilità civile e l'ipotesi di "personalità elettronica"

La natura della responsabilità civile per danno causato da algoritmo dipende, quindi, dalla definizione che l'ordinamento fornisce di intelligenza artificiale. I dispositivi dotati di A.I. si caratterizzano per tre elementi: l'interattività, l'autonomia ed infine l'adattabilità. In tal modo un algoritmo ordinario riceve una serie predefinita di dati o input, li analizza e, applicando un modello stabilito dal programmatore, produce degli output. Maggiori problemi sorgono quando un algoritmo viene generato tramite machine learning o deep learning, in quanto alle tre caratteristiche standard se ne aggiunge una terza: l'imprevedibilità.

L'autonomia mediante l'esperienza e l'autoapprendimento si trasforma in capacità di lavorare dati in continua evoluzione, tanto da permettere al dispositivo di adottare decisioni (decision making) e di attuarle indipendentemente dal controllo o da elementi esterni che possono influire su di esse.

La responsabilità dei danni generati da algoritmi del primo caso inevitabilmente ricadrebbe su tutti coloro che hanno preso parte alla catena di produzione, proprio come accade per i danni causati da prodotti difettosi; nel secondo caso, invece, l'elevata automatizzazione, con conseguente perdita di controllo del produttore, potrebbe portare ad un nuovo genus di responsabilità.

Accanto ed a completamento di una responsabilità per colpa o negligenza-produttiva, consistente nella violazione di regole di condotta esigibili in base agli standard massimi di settore, si dovrebbe introdurre, un'ulteriore responsabilità, creata ad hoc sulle caratteristiche delle A.I, che sostituisca o integri la responsabilità per danni da difetti del prodotto.

Diverse ipotesi sono state vagliate: c'è chi ha proposto una limitazione di responsabilità con una "immunità selettiva" nei confronti di produttori di piattaforme robotiche aperte; chi invece la creazione di una personalità giuridica ad hoc per i "robot"; chi invece una responsabilità oggettiva dell'utente o proprietario del robot.

La prima ipotesi favorirebbe l'ascesa dell'industria, ma non una regolamentazione del problema, che continuerebbe a sussistere. La terza ipotesi, richiamando l'art. 2051 c.c., considera responsabile l'utilizzatore nella sua veste di custode del bene in virtù dei suoi obblighi di controllo e vigilanza sulla cosa. Tuttavia, anche questa proposta non sembra valutabile, poiché punirebbe unicamente il proprietario/utilizzatore, in favore del danneggiato, non terrebbe conto della responsabilità del produttore (responsabile solo per danni da prodotti difettosi) e diventerebbe un deterrente all'acquisto. La più interessante è la proposta di attribuire una sorta di personalità giuridica ai "robot autonomi più sofisticati", la c.d. "personalità elettronica".

Alla pari di altre entità riconosciute nell'ordinamento giuridico, come enti o associazioni, i "robot autonomi più sofisticati", quali "persone elettroniche", avrebbero una capacità giuridica e d'agire, ma anche un'autonomia personale e patrimoniale, che permetterebbe loro di adempiere alle obbligazioni assunte e quindi di risarcire il danno. All'autonomia decisionale e di interazione con l'ambiente esterno corrisponderebbe un'autonomia patrimoniale.

Autorevole dottrina considera questa tesi della "personalità elettronica" molto più efficiente rispetto al tentativo di adattare schemi di responsabilità standard ridotti previsti nella prima proposta. Inoltre, ritiene che potrebbe configurare un sistema funzionante qualora la capacità cognitiva e decisionale dei robot fosse assimilata a quella dei soggetti che, per età o per indebolimento psico fisico, non sono chiamati a rispondere in prima persona dei danni provocati agli altri, ma sono sostituiti nella funzione risarcitoria da coloro che se prendono cura. Nonostante il Parlamento Europeo sembrasse prediligere l'ipotesi di creazione di un nuovo status, il Comitato Economico e Sociale Europeo si è opposto saldamente a questa tesi, definendo l'introduzione della personalità elettronica un "rischio di azzardo morale", che porterebbe alla completa deresponsabilizzazione del produttore.

Tutte le criticità evidenziate nella parte occidentale del mondo circa la creazione di una "personalità elettronica" non trovano spazio in Oriente. La Società Giapponese per l'Intelligenza (JSAI), già nel febbraio 2017, all'art. 9 delle linee guida che devono essere applicate tra i suoi membri, prevedeva un "obbligo" per le A.I. di "attenersi alle politiche stabilite allo stesso modo dei membri della JSAI (Società Giapponese per l'intelligenza) al fine di diventare un membro o un quasi-membro della società".

Prospettazioni del Parlamento europeo: responsabilità oggettiva, regimi assicurativi e fondi risarcimento

Il Parlamento europeo constatando il vuoto normativo in questa materia ha prospettato due diversi orientamenti. L'imprevedibilità e l'inevitabilità delle condotte poste in essere da dispositivi dotati di A.I. super evolutivi, interromperebbe il nesso di causalità tipico della responsabilità oggettiva per prodotti difettosi. Quindi, accanto alle problematiche circa la definizione di prodotto e la sua tangibilità, per l'applicazione della direttiva 85/374/CEE, si pone un ulteriore questione di incompatibilità di responsabilità. Le disposizioni di questa direttiva porterebbero a considerare le "macchine" quali "meri strumenti nelle mani di altri attori" (il fabbricante, l'operatore, il proprietario, l'utilizzatore), senza tener conto dell'autonomia di cui sono dotati.

Il primo modello definito nella risoluzione del febbraio 2017 si basa sul riconoscimento di una responsabilità oggettiva che richiederebbe una "semplice prova del danno avvenuto e l'individuazione di un nesso di causalità tra il funzionamento lesivo del robot e il danno subito dalla parte lesa". Il secondo modello, invece, prevede una "gestione dei rischi", in modo da individuare il responsabile in colui che, tra i potenzialmente coinvolti, è casualmente in "grado di minimizzare i rischi e ridurre l'impatto negativo". Quest'ultimo modello considera responsabile il soggetto che nella catena di produzione ha agito "in ultima istanza", la cui responsabilità dovrebbe essere proporzionale all' "effettivo livello di istruzioni impartite ai robot". A riguardo, il punto 56 opera una distinzione nella produzione tra le competenze derivanti dalla "formazione del robot" e quelle che dipendono "strettamente dalla sua capacità di autoapprendimento", e specifica che "quanto maggiore è la capacità di apprendimento o l'autonomia di un robot e quanto maggiore è la durata della formazione di un robot", "tanto maggiore dovrebbe essere la responsabilità del suo formatore". La responsabilità del formatore riconosciuta nel punto 56 viene messa in discussione dalla lettera f) del punto 59, dove, tra le soluzioni giuridiche possibili si prevede l'adozione di uno "status giuridico specifico".

Per tutte le ragioni sopra esposte non sembra compatibile con gli istituti giuridici attuali una "responsabilità del robot", basata sulla personalità elettronica. Tuttavia, si potrebbe avere una scissione della responsabilità, ponendo da un lato la responsabilità del produttore/formatore per l'errore/malfunzionamento dell'algoritmo e di conseguenza del danno, e dall'altro una "responsabilità del robot" al "risarcimento di qualsiasi danno da causato" dalla propria autonomia.

A sostegno di questa ipotesi di responsabilità oggettiva nella risoluzione si invita la Commissione nominata ad hoc ad esaminare dettagliatamente la disciplina del risarcimento del danno, prevedendo due strumenti utilizzabili contemporaneamente o in maniera alternativa.

Il danno causato da un soggetto ma risarcito da un altro è il principio posto alla base dei contratti di assicurazione. Infatti, il Parlamento europeo, prendendo come modello il regime assicurativo dei veicoli a motore, ha previsto l'istituzione di un regime di assicurazione obbligatoria. La copertura assicurativa, come avviene per i danni causati dalla guida al volante, comprenderebbe "tutte le potenziali responsabilità lungo la catena". Di conseguenza, anche il settore assicurativo dovrebbe elaborare nuovi prodotti e nuove tipologie di offerte ad hoc. In aggiunta al regime assicurativo e nel caso di danno causato da robot non assicurato, si prevede lo strumento del fondo di risarcimento, che potrebbe assumere portata individuale o generale e caratterizzarsi per versamenti periodici oppure una tantum. Il ricorso a questi strumenti, che assicurano il risarcimento del danno. La sottoscrizione di un contratto assicurativo e/o la costituzione di un fondo permetterebbero al produttore, programmatore, proprietario di godere di una responsabilità limitata.

In tal modo il danneggiato otterrebbe sempre un risarcimento, sorpassando le difficoltà nell'individuare chi tra i soggetti coinvolti nel processo di realizzazione e vendita del dispositivo (produttore e programmatore) sia l'autore delle azioni da cui sia derivato l'errore o il malfunzionamento.

Le contraddizioni in merito alla natura della responsabilità ed alla creazione di una nuova personalità vengono completamente superate nella parte del risarcimento del danno, in cui l'uomo ritorna ad essere l'unico soggetto di diritto, a cui spetta la piena tutela e la cui libertà ed autodeterminazione non potrà mai essere subordinata al controllo di sistemi basati su algoritmi.

.jpg)