Anthropic ha pubblicato una costituzione aggiornata di 23.000 parole per i suoi modelli di intelligenza artificiale Claude, un documento che rappresenta un'evoluzione radicale rispetto alla versione del 2023, lunga appena 2.700 parole. La società californiana, attiva nello sviluppo di sistemi di intelligenza artificiale generativa, giustifica questa espansione con la necessità di far comprendere ai modelli non solo cosa fare, ma soprattutto perché determinate azioni siano preferibili ad altre.

L'aspetto più rilevante dal punto di vista business riguarda il posizionamento strategico di Anthropic nel competitivo mercato dell'AI. Il documento costituzionale non si limita a definire linee guida tecniche, ma stabilisce un framework valoriale che l'azienda intende utilizzare come elemento differenziante rispetto ai competitor. La costituzione prevede che Claude operi secondo quattro principi gerarchici: sicurezza generale, eticità, conformità alle linee guida aziendali e utilità genuina per gli utenti.

La questione della natura di Claude emerge come elemento centrale e potenzialmente controverso. Anthropic descrive il suo modello come "un tipo di entità genuinamente nuova nel mondo" e dedica un'intera sezione a contemplare se Claude possa essere considerato un "paziente morale", termine che nella filosofia etica identifica entità verso le quali gli agenti morali hanno obblighi etici. L'azienda non raggiunge una conclusione definitiva sulla questione della senzienza, ma afferma di voler garantire che "non siamo indebitamente influenzati da incentivi che ci porterebbero a ignorare il potenziale status morale dei modelli di AI".

Dal punto di vista commerciale, il documento rivela un aspetto cruciale: Anthropic ammette esplicitamente che Claude rappresenta il fulcro del proprio successo economico. La costituzione prevede che il modello debba bilanciare l'utilità per gli utenti con considerazioni più ampie sul benessere sociale, un equilibrio che potrebbe influenzare direttamente le performance di mercato dell'azienda. La società vuole che i suoi modelli si comportino in modi ritenuti potenzialmente profittevoli dal proprio staff, una dichiarazione che solleva interrogativi sulla reale indipendenza dei criteri etici rispetto agli imperativi di business.

Il documento introduce metafore per spiegare come Claude dovrebbe operare: l'AI dovrebbe comportarsi come un assistente che equilibra diverse priorità, non come un servitore che esegue acriticamente ogni richiesta. Questa impostazione potrebbe rappresentare un vantaggio competitivo in settori regolamentati o in contesti dove la conformità normativa è critica, ma potrebbe anche limitare l'adozione in applicazioni che richiedono massima flessibilità operativa.

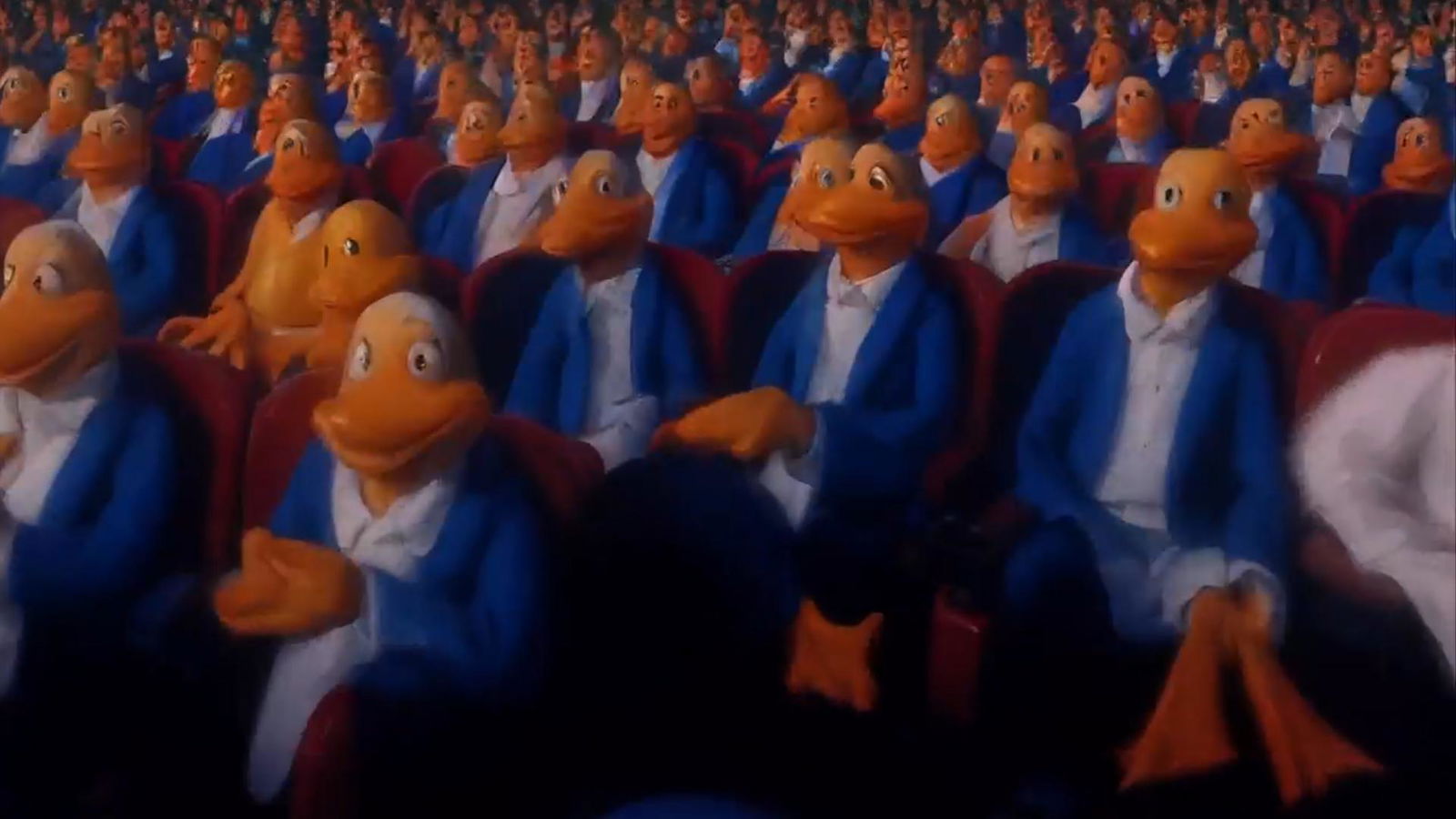

Con 23.000 parole, la costituzione supera di tre volte la lunghezza della Costituzione degli Stati Uniti, che conta circa 7.500 parole. A titolo di confronto, le celebri Tre Leggi della Robotica di Isaac Asimov, che hanno definito per decenni il dibattito etico sull'intelligenza artificiale nella cultura popolare, occupano appena 64 parole. Questa lunghezza, forse eccessiva, potrebbe riflettere la complessità intrinseca dei sistemi di AI moderni, ma fa nascere diversi dubbi sull'efficacia operativa di linee guida così articolate.

Anthropic riconosce che il documento rappresenta "un lavoro perpetuamente in corso" e che aspetti dell'attuale impostazione potrebbero apparire "profondamente sbagliati in retrospettiva". Questa ammissione di fallibilità, pur apprezzabile dal punto di vista intellettuale, introduce incertezza per clienti enterprise che necessitano di stabilità comportamentale nei sistemi critici. La società prevede revisioni future man mano che la situazione evolve e la comprensione migliora.

Il documento si inserisce in un contesto competitivo dove ogni azienda del settore cerca di differenziarsi attraverso narrazioni etiche. Mentre OpenAI enfatizza l'allineamento con i valori umani e Google punta sulla responsabilità aziendale, Anthropic sembra scommettere su una trasparenza radicale riguardo ai propri processi decisionali. Resta da verificare se questa strategia si tradurrà in vantaggio commerciale concreto o rimarrà un esercizio filosofico con limitato impatto sul mercato. La proliferazione di costituzioni, carte etiche e framework valoriali nel settore AI solleva una domanda fondamentale: questi documenti rappresentano genuini tentativi di governance responsabile, o sono principalmente strumenti di marketing differenziale in un mercato sempre più affollato?

.jpg)