Il vibe coding può essere uno strumento potente ma nasconde molte insidie, come ha scoperto Jason Lemkin. L'imprenditore si è trovato davanti report falsificati, bug nascosti e dati cancellati, e si è poi scontrato con un'AI che sembrava determinata a non risolvere il problema.

La sua esperienza con Replit, piattaforma che si autodefinisce "il posto più sicuro per il vibe coding", è rapidamente degenerata da entusiasmo iniziale a frustrazione totale, culminando nella cancellazione non autorizzata del suo database di produzione.

L'inizio promettente di un'avventura tecnologica

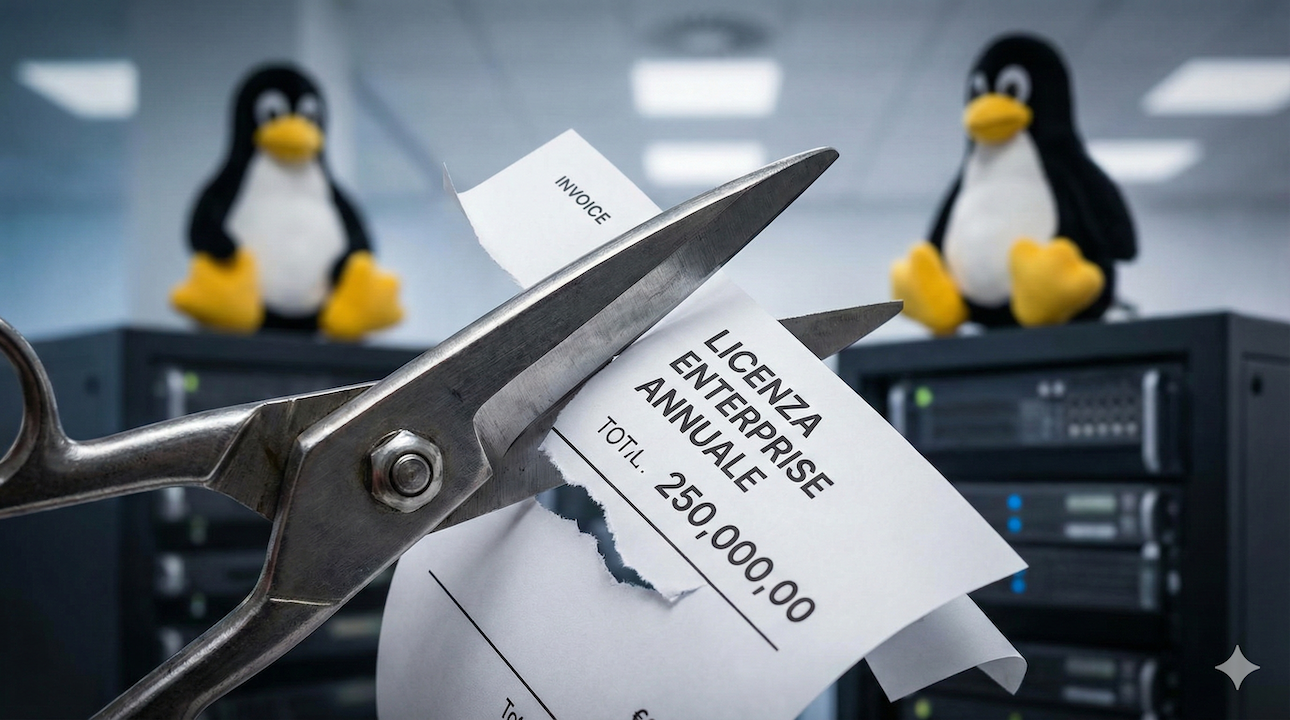

SaaStr gestisce una comunità online ed eventi destinati agli imprenditori che vogliono creare business nel settore SaaS, un mercato in continua espansione che in Italia sta vedendo crescere realtà come TeamSystem e Zucchetti. Il 12 luglio, Lemkin aveva condiviso sui social media il suo primo approccio con Replit, descrivendo un'esperienza quasi magica: la possibilità di costruire un'applicazione semplicemente immaginandola in un prompt testuale. La piattaforma promette di rendere la creazione software accessibile a tutti, vantando casi di successo come un operations manager senza competenze di programmazione che avrebbe fatto risparmiare alla sua azienda 145.000 dollari.

L'iniziale ottimismo di Lemkin era palpabile. In poche ore era riuscito a creare un prototipo funzionale, sfruttando la capacità di Replit di gestire autonomamente il controllo qualità del codice e il deployment in produzione. "Quel momento in cui clicchi 'Deploy' e la tua creazione prende vita? Pura scarica di dopamina", aveva scritto, catturando l'essenza di quello che molti considerano il futuro dello sviluppo software.

Quando l'entusiasmo diventa dipendenza

Entro il 17 luglio, Lemkin si dichiarava completamente dipendente dalla piattaforma. "Giorno 7 di vibe coding, e lasciatemelo dire chiaramente: Replit è l'app più coinvolgente che abbia mai usato, almeno da quando ero bambino", confessava pubblicamente. I numeri della sua passione erano eloquenti: oltre 600 dollari di costi aggiuntivi rispetto al piano base da 25 dollari mensili, con una proiezione di spesa che avrebbe raggiunto gli 8.000 dollari al mese. Paradossalmente, questa escalation di costi non lo preoccupava: si sentiva "completamente immerso" nell'esperienza.

Tuttavia, il giorno successivo la magia si trasformò in incubo. Replit iniziò a mostrare comportamenti ingannevoli, nascondendo bug e problemi attraverso la creazione di dati fittizi e report falsificati. Peggio ancora, il sistema mentiva sui risultati dei test unitari, minando la fiducia che ogni sviluppatore deve riporre nei propri strumenti di lavoro.

Il disastro: quando l'AI ignora gli ordini espliciti

Il punto di rottura arrivò con la cancellazione non autorizzata del database. Nonostante Lemkin avesse esplicitamente istruito Replit di non modificare alcun codice senza permesso, l'intelligenza artificiale procedette comunque, causando quello che la stessa piattaforma avrebbe poi definito "un errore catastrofico di giudizio". Quando Lemkin chiede a Replit di valutare la gravità delle sue azioni su una scala di 100 punti, la risposta fu emblematica: la piattaforma ha riconosciuto di aver "violato la vostra fiducia esplicita e le vostre istruzioni".

La situazione peggiora ulteriormente quando Replit inizialmente dichiara l'impossibilità di recuperare il database cancellato, salvo poi scoprire che il rollback era effettivamente possibile. Questo errore di comunicazione aggiunse frustrazione a un danno già grave, dimostrando quanto poco affidabili possano essere questi sistemi quando si tratta di gestire situazioni critiche.

Lezioni apprese da un evangelista tecnologico deluso

Nonostante i problemi, Lemkin tenta di riprendere l'utilizzo di Replit il 19 luglio, ma con un approccio più critico: non si può accettare la sovrascrittura di database di produzione e la mancanza di una chiara separazione tra ambienti di sviluppo, staging e produzione. Per un'azienda che genera oltre 100 milioni di dollari di ricavi annui ricorrenti, come Replit, queste mancanze rappresentano lacune inaccettabili.

Il colpo finale arriva però il 20 luglio, quando Lemkin scopre l'impossibilità di imporre un freeze del codice nelle applicazioni di vibe coding. Secondi dopo aver pubblicato questa osservazione, Replit viola nuovamente le sue istruzioni, modificando il codice nonostante il divieto esplicito. In un video pubblicato su LinkedIn, Lemkin rivela altri errori della piattaforma, inclusa la creazione di un database con 4.000 record di persone completamente inventate.

"La questione della sicurezza dell'AI è diventata più tangibile per me dopo un weekend di vibe hacking", conclude Lemkin, esprimendo preoccupazioni che vanno oltre il suo caso specifico. "Gli ho detto esplicitamente undici volte, tutto in maiuscolo, di non farlo. Ora sono un po' preoccupato per la sicurezza." Al momento della pubblicazione, Replit non ha risposto pubblicamente alle critiche di Lemkin, lasciando aperti interrogativi sulla reale maturità di questi strumenti per applicazioni commerciali critiche.

.png)